Metaはこのたび、コミュニティ規定施行レポートの第12版*1を公開します。今回のレポートでは、2021年第4四半期(10月から12月まで)におけるポリシーの施行状況に関連する指標を提供しています。

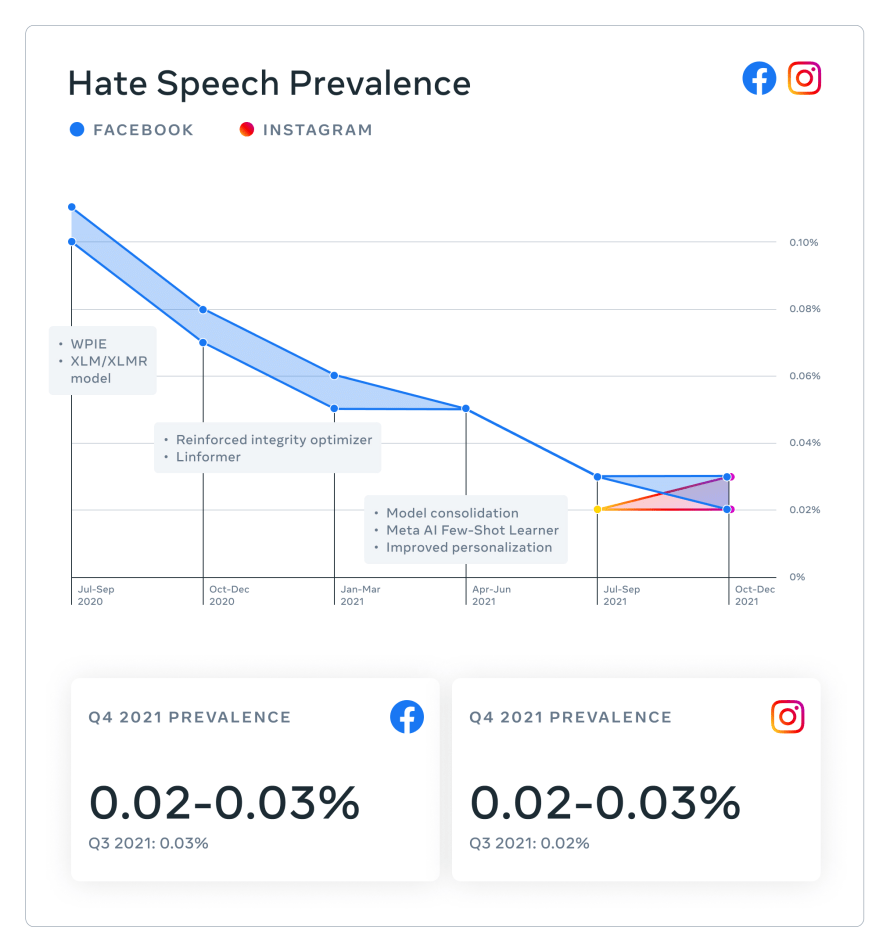

- FacebookとInstagramにおける有害なコンテンツの表示頻度は、事前検知技術の向上と拡充の影響もあり、第3四半期から第4四半期にかけて、いくつかのポリシー項目において比較的同水準に推移もしくは減少しました。

今期はFacebookの14のポリシー項目、Instragramの12のポリシー項目について報告します。このレポートでは、さらに以下の情報を併せて公開します。

- 2021年第4四半期の広範囲に閲覧された米国のコンテンツに関するレポート*1

- 2021年第4四半期の監督委員会による四半期レポート*1

- Metaのテクノロジーの不正利用防止や効果的で公正な施行を促進するためのインテグリティ・デザインの取り組みに関するDesign Blog*1の投稿

これらすべてのレポートは透明性センター*1でも公開しています。

コミュニティ規定施行レポート第12版に関するハイライト

FacebookとInstagramにおける第3四半期から第4四半期にかけての有害なコンテンツの表示頻度は、比較的同水準で推移し、いくつかのポリシー項目において減少しました。これは、利用者が一般的に目にする大半のコンテンツが、Metaのコミュニティ規定に違反していないことを意味しています。

Metaが措置を講じたコンテンツの数は、多くのポリシーにおいて継続して一定の水準を維持しています。

第4四半期におけるFacebook上で措置を講じたコンテンツの数は以下の通りです。

- 400万件の薬物に関連するコンテンツ(事前検知技術の向上より、2021年第3四半期の270万件から増加)

- 150万件の銃火器に関連するコンテンツ(事前検知技術の向上により、第3四半期の110万件から増加)

- 12億件のスパムコンテンツ(2021年12月に大量のコンテンツを削除したことにより、第3四半期の7億7700万件から増加)

第4四半期におけるInstagram上で措置を講じたコンテンツの数は以下の通りです。

- 90.5万件のテロに関連するコンテンツ(事前検知技術の向上に伴い、第3四半期の68.5万件から増加)

- 19.5万件の銃火器に関連するコンテンツ(事前検知技術の向上に伴い、第3四半期の15.4万件から増加)

第3四半期では、いじめと嫌がらせの表示頻度に関する指標*1を初めて公開しました。Instagramにおいて、第4四半期におけるいじめと嫌がらせに関するコンテンツの表示頻度は0.05〜0.06%で、第3四半期から大きく推移していません。Facebook上では、第4四半期におけるいじめと嫌がらせに関するコンテンツの表示頻度は0.11〜0.12%と、第3四半期の0.14〜0.16%から低下しています。追加の文脈がなければ攻撃的とみなされた言葉のうち、実際には友達の間で親しげに、もしくは冗談として使われる言葉を考慮するポリシーの更新によって、表示頻度が低下したことが一因です。

有害なコンテンツの抑制における堅調な進歩

Metaの堅調な進歩は、私たちのポリシーやテクノロジー、世界規模のコンテンツモデレーションの運用、安全性と正当性に焦点を当てた製品設計など、総合的な取り組みによるものです。

少ないデータで効率的に学習することができる少数ショットラーニング*1や汎用型AI*1への移行などのAIの進歩によって有害なコンテンツをより早く正確に対処することができるようになりました。

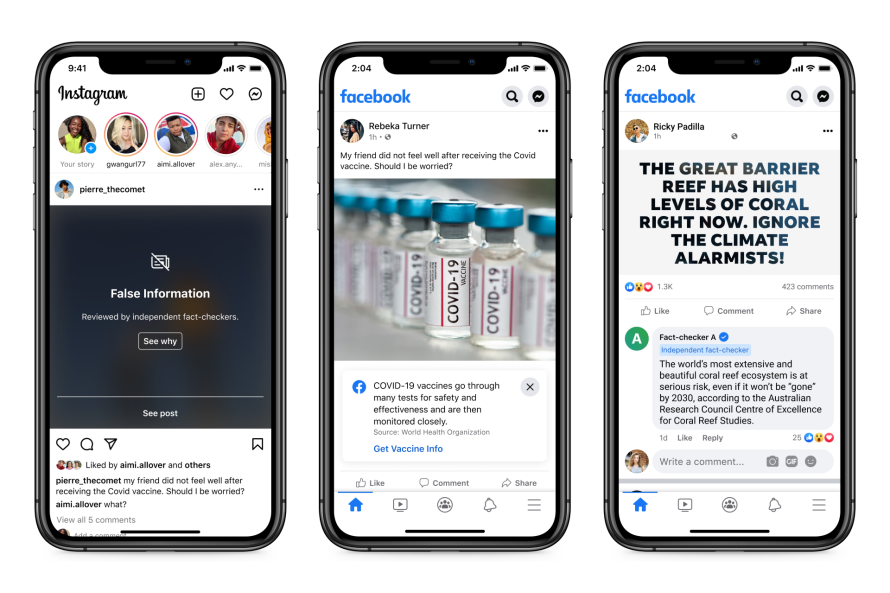

Metaの製品開発チームは、有害なコンテンツの抑制において重要な役割を担っています。私たちが提供する製品を慎重にデザインすることで、より安全性を高めることができると同時に、利用者に文脈やコンテンツを管理する方法、意見を共有できる場所を提供することができます。例えば、情報量の多いオーバーレイやラベルを適用することで、より多くの文脈を提供し、誤情報や不適切な画像などのコンテンツに触れる機会を制限することができます。インテグリティ・デザインプロセスの詳細はこちら*1をご覧ください。

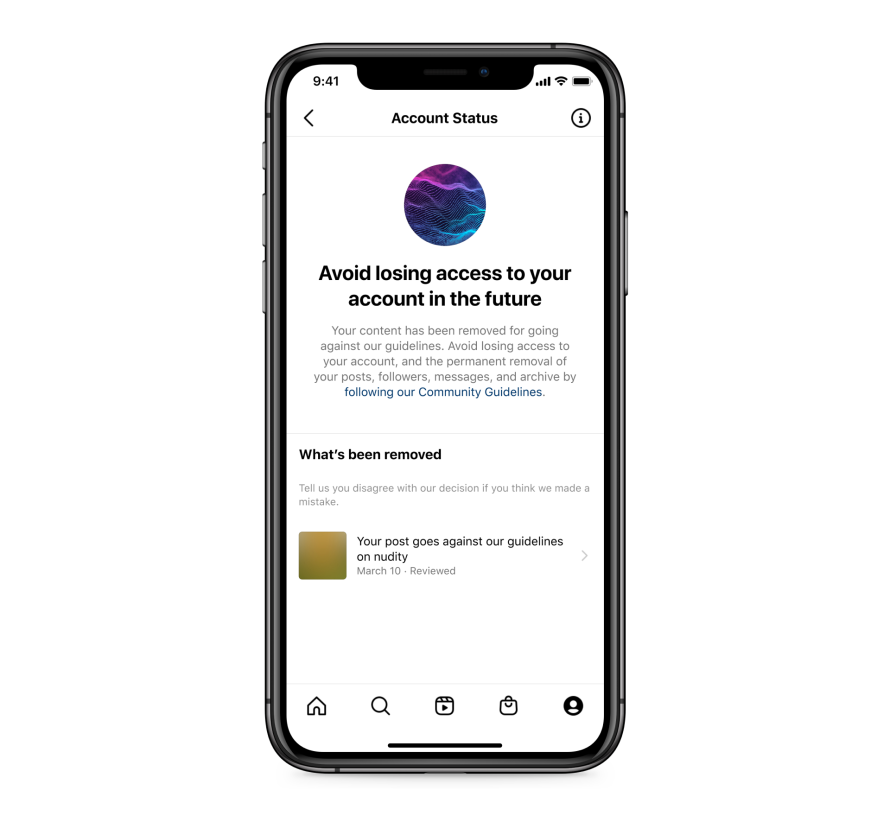

2021年10月、私たちはInstagramに、利用者が自身のコンテンツが削除された理由や違反しているポリシーについて理解するのに役立つアカウントステータスを導入(*現時点で日本では未導入)しました。このような透明性は、利用者がポリシーを理解することに役立ち、誤りが生じた際にそれを示すことで、Metaのポリシー施行システムにも貢献するため、重要だと考えています。コンテンツが誤って削除されたと思う場合は、この機能を通じて再審査のリクエストを出すこともできるため、アカウントステータスの導入後、Instagram上の、暴力と扇動、ヘイトスピーチ、いじめや嫌がらせ、成人のヌード、性的なコンテンツなど複数のポリシー項目において、復元されたコンテンツの数が増加しました。

Metaは、施行が不十分、もしくは過剰に施行をしている可能性のあるポリシーの見直しを常に行い、改善に努めています。例えば、2020年の乳がん啓発月間には、Instagramに乳がん関連のコンテンツが増大し、その中には胸部の露出が含まれる医療関連のコンテンツも含まれていました。これらのコンテンツはMetaのポリシーに違反しませんが、多くはMetaのシステムによって誤った措置が講じられ、乳がんに関する支援アカウントや乳がん経験者によるコンテンツが削除されました。このような種類のコンテンツに対する措置について、改善の必要があるとコミュニティからの要望がありました。また、監督委員会への申し立てがあった案件の中には乳がんの症状と成人のヌード*1に関連する事例があり、適切なポリシー施行への改善について要請を受けました。

このような状況を受け、乳がんや外科手術に関連するコンテンツを含む健康に関するコンテンツのポリシー施行の精度向上に取り組んでいます。FacebookとInstagramではヌードコンテンツの表示を制限していますが、乳房切除術の跡がある胸部の画像をより正確に認識できるようAIに学習させ、医療用画像としてフラグが立てられたコンテンツを人員がレビューすることで、認められるヌードコンテンツについて明確な基準を設けました。また、使用頻度の高いキーワードもコンテンツレビュアーと共有しています。さらに、より適切にポリシーを施行し、無害で違反のない画像の認識を向上させるため、AIに学習させました。その結果、昨年の乳がん啓発月間には過剰なポリシー施行が大幅に減少し、コミュニティがオープンにコンテンツを共有できるようになりました。

信頼性と透明性の今後の展望

Metaは、プラットフォームの信頼性と透明性を向上する新しい方法を常に模索しています。長年にわたり、Metaは透明性レポート*1を半期に一度、発行してきました。レポートには、Metaのコミュニティ規定には違反しないものの、現地法に違反すると報告されたために措置を講じられたコンテンツ*1の数が含まれています。Metaは、ハーバード大学バークマン・センターの、オンラインコンテンツに関する政府および民間団体からの排除・差止申立書について研究を行う独立研究プロジェクトLumen*1に貢献することに合意しました。MetaがLumenプロジェクトへ参画したのは、現地法に基づいて削除を要求されたコンテンツに対して、政府、裁判所、規制当局、そして私たち自身に責任を課すことができるためです。

Metaは、常に改善、透明性の確保、そして有意義なデータの共有に努めており、2022年もポリシーの強化のために進歩し続けてまいります。

*1英文のみで公開しています。