El segundo día de F8 se enfocó en las inversiones a largo plazo que estamos realizando en las áreas de inteligencia artificial, realidad aumentada y realidad virtual. Durante el discurso de apertura, el Director de Tecnología, Mike Schroepfer, habló sobre las herramientas de inteligencia artificial que utilizamos para abordar una serie de desafíos en nuestros productos, y explicó las razones por las que es optimista sobre lo que vendrá en el futuro.

Después de Schroepfer, subieron al escenario Manohar Paluri y Joaquín Quinonero Candela del área de inteligencia artificial, Margaret Stewart de Diseño de Producto, y Lade Obamehinti, Lindsay Young y Ronald Mallet del área de realidad aumentada y realidad virtual.

Inteligencia Artificial

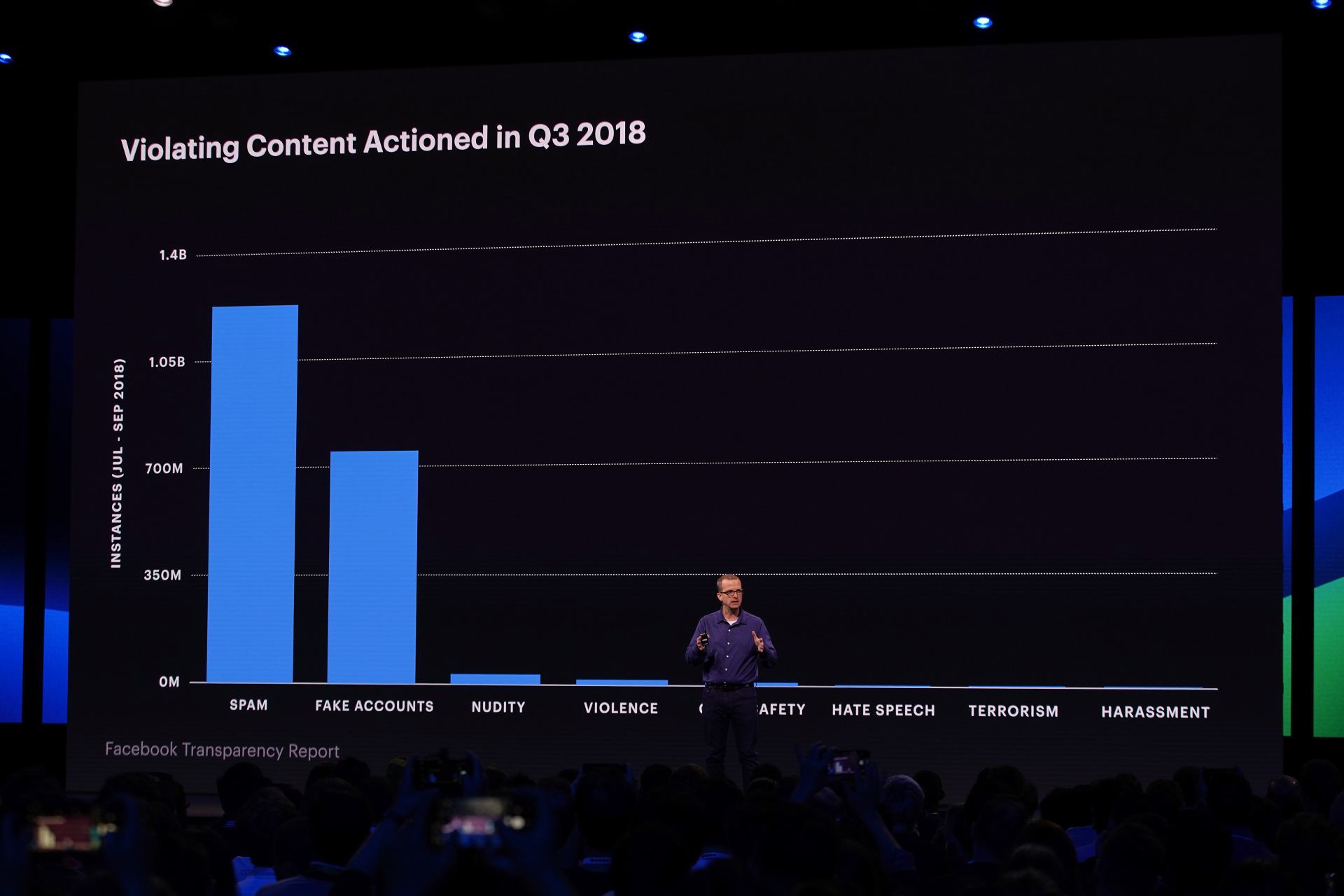

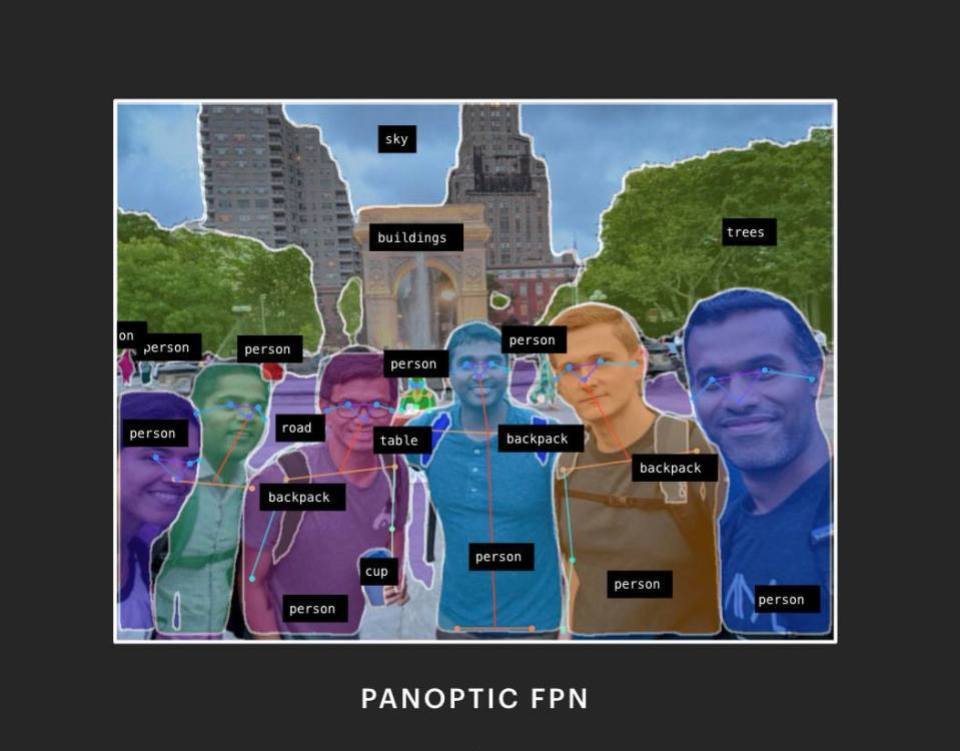

La inteligencia artificial es esencial para un amplio rango de productos e infraestructura en Facebook. Recientemente, esto ha incluido detectar proactivamente contenido que viole nuestras políticas. Para ayudarnos a localizarlo, trabajamos para asegurarnos que nuestros sistemas de inteligencia artificial entiendan el contenido con la menor supervisión posible. Hemos logrado importantes avances, pero aún tenemos mucho trabajo por delante. Los avances en el procesamiento de lenguajes naturales (NLP por sus siglas en inglés) nos han ayudado a crear un lenguaje común para traducciones, y de esta forma detectar contenido problemático en más lenguajes. También tenemos un nuevo acercamiento a reconocimiento de objetos llamado Panoptic FPN, el cual ayuda a nuestros sistemas impulsados por inteligencia artificial a entender el contexto, por el fondo de las fotos. Entrenar modelos que combinan señales visuales y auditivas han mejorado los resultados.

Nuestro trabajo en el procesamiento de lenguajes naturales es importante, pero muchas técnicas funcionan mejor para los lenguajes más comunes. Por esto también necesitamos trabajar en apoyar los otros lenguajes donde no hay suficientes muestras para entrenar. Aquí es donde entran en juego las técnicas de aprendizaje con supervisión propia. Éstas nos permiten entrenar modelos sin necesidad de curaduría con humanos para etiquetar grandes conjuntos de datos para esos nuevos lenguajes. Esto nos permite entender mejor el contenido relevante, incluyendo las violaciones a las políticas de Facebook, sin traducir cada uno de los enunciados. Estas técnicas aseguran que todos nuestros clasificadores detecten el contenido problemático en más lenguajes de los que anteriormente era posible.

La inteligencia artificial es fundamental para mantener nuestra plataforma segura, pero sabemos que hay riesgos, pues puede reflejar y ampliar sesgos. Para abordar esto, estamos construyendo buenas prácticas para la imparcialidad –asegurándonos de que la inteligencia artificial proteja a las personas y no las discrimine– en cada paso del desarrollo del producto.

Cuando los modelos de inteligencia artificial son entrenados por humanos en conjuntos de datos que involucran a personas, existe un riesgo representativo inherente. Si los conjuntos de datos contienen limitaciones, fallas u otros problemas, los modelos resultantes pueden funcionar de manera diferente para diferentes personas. Para gestionar ese riesgo, desarrollamos un nuevo proceso para inteligencia artificial inclusiva. Éste proporciona pautas para ayudar a los investigadores y programadores a diseñar conjuntos de datos, medir el rendimiento del producto y probar nuevos sistemas a través de la lente de inclusión. Para la visión, esas dimensiones incluyen el tono de la piel, la edad y la presentación de género, y para la voz incluyen el dialecto, la edad y el género. El marco inclusivo de inteligencia artificial ahora se usa en muchos equipos de producto en Facebook y se integra en el desarrollo de nuevas características.

Para una inmersión más profunda en todas las actualizaciones y avances de inteligencia artificial de hoy, consulte las publicaciones en nuestro blog de IA.

Realidad aumentada y realidad virtual

Una de las áreas en las que estamos utilizando el marco inclusivo de la inteligencia artificial es la realidad aumentada (AR). Los ingenieros de Spark AR lo utilizan para garantizar que su software ofrezca efectos AR de calidad para todos. Por ejemplo, algunos de los efectos son provocados por un gesto de la mano, por lo que los datos de entrenamiento incluyó varios tonos de piel bajo una variedad de condiciones de iluminación para asegurar que el sistema siempre reconociera que había una mano frente a la cámara. Los ingenieros de Oculus también utilizan este proceso para comandos de voz en VR, con datos representativos en dialectos, edades y géneros.

Mientras trabajamos para asegurarnos de que nuestra tecnología no excluya a las personas, también nos aseguramos de que ayude a unir a las personas. Con la realidad virtual, vemos un futuro donde las gente pueden interactuar y unirse, sin importar la distancia física. Para lograr esto, las personas necesitan sentirse completamente presentes en la realidad virtual. Eso significa que necesitamos avatares realmente realistas, con gestos, expresiones faciales y tono de voz que agreguen matices a nuestras conversaciones.

Hemos demostrado un realismo innovador en los rostros de nuestros Codec Avatars, que permiten a las personas interactuar en tiempo real en la realidad virtual. Pero la comunicación genuina requiere de todo el cuerpo. Es por eso que estamos desarrollando modelos totalmente adaptables basados en la física que reproducen un avatar 3D con datos de un número limitado de sensores. Utilizamos un enfoque en capas que reproduce la anatomía humana y puede adaptarse automáticamente para coincidir perfectamente con la apariencia y el movimiento único de cualquier individuo. Diseñamos estos modelos de adentro hacia afuera, desarrollando un esqueleto virtual y luego sumando por capas la estructura muscular, la piel y la ropa. El resultado: avatares realistas, hasta en el movimiento muscular y el drapeado de la ropa. Todavía tenemos un largo camino por recorrer antes de que los resultados de esta investigación se conviertan en un producto, pero lo logrado hasta ahora nos alienta.

Al igual que la realidad aumentada, queremos que la realidad virtual sea incluyente y segura para todos. Hemos construido sistemas preventivos –como un código de conducta para todos los que usan o construyen nuestros auriculares– que fomentan una cultura e interacciones respetuosas. Y hemos construido sistemas reactivos, que incluyen herramientas para reportar o bloquear a los usuarios que infrinjan las normas.

Cuando lanzamos nuestras propias aplicaciones sociales de realidad virtual, incluyendo Spaces, Venues y Rooms, incorporamos la seguridad en el diseño central de la experiencia. Un video de orientación presenta a las personas algunas de las características diseñadas para hacerlos sentir más cómodos al interactuar con un grupo grande de personas mientras estén en la realidad virtual. Por ejemplo, la burbuja de seguridad es una función que evita que personas u objetos se acerquen más de lo que te gustaría. Si un avatar entra en la burbuja de seguridad de otro, ambos avatares se vuelven invisibles entre sí. También contamos con moderadores en vivo para ayudar a garantizar un buen comportamiento y revisar informes de comportamiento inapropiado.

Las herramientas y los procesos que compartimos hoy son parte de cómo nos estamos preparando para lo que viene. Para nosotros, este trabajo consiste en brindar la misma voz y la oportunidad a personas de todo el mundo, para ayudarlas a mantenerse conectadas entre sí. Para conocer más sobre los anuncios de ayer, lee nuestro Resumen del Día 1. Para obtener más detalles sobre las noticias de hoy, consulta nuestro blog de Desarrolladores, el blog de IA, el blog de Ingeniería, el blog de Oculus, el Newsroom de Instagram y el Newsroom de Facebook. También puedes ver todas las notas importantes sobre el F8 en la página de Facebook para Desarrolladores.