Metaはこのたび、コミュニティ規定施行レポートの第11版(日本語版 Facebook, Instagram, 指標について)を公開します。今回のレポートでは、2021年第3四半期(7月から9月まで)におけるポリシーの施行状況に関連する指標を提供しています。

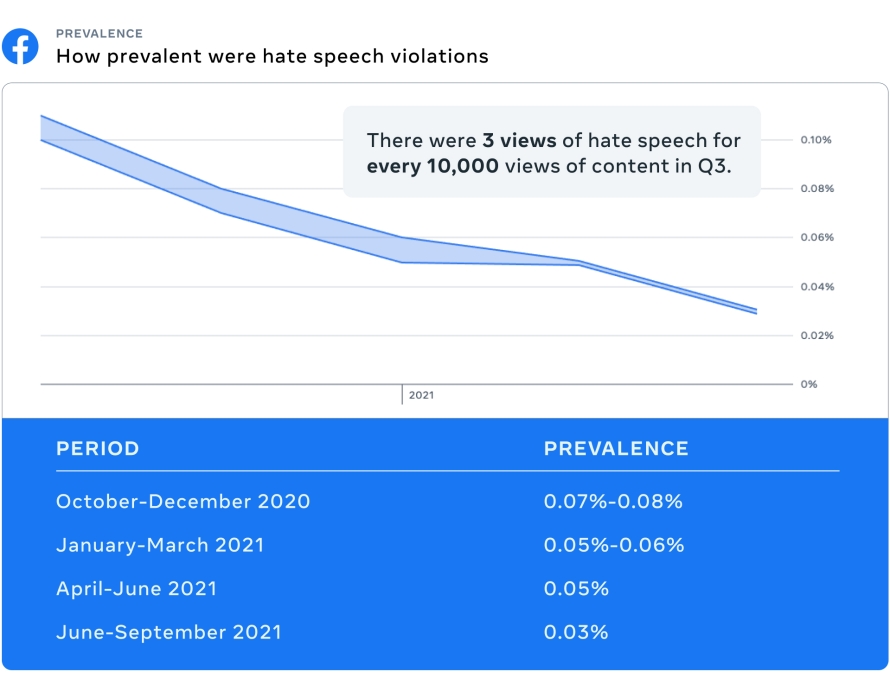

- Facebookにおけるヘイトスピーチの表示頻度は、4四半期連続で低下し続けています。テクノロジーの向上とニュースフィード上の問題のあるコンテンツの表示頻度を減らすために行った変更*1によって、この1年間でヘイトスピーチの表示頻度を半分以下に減らしました。

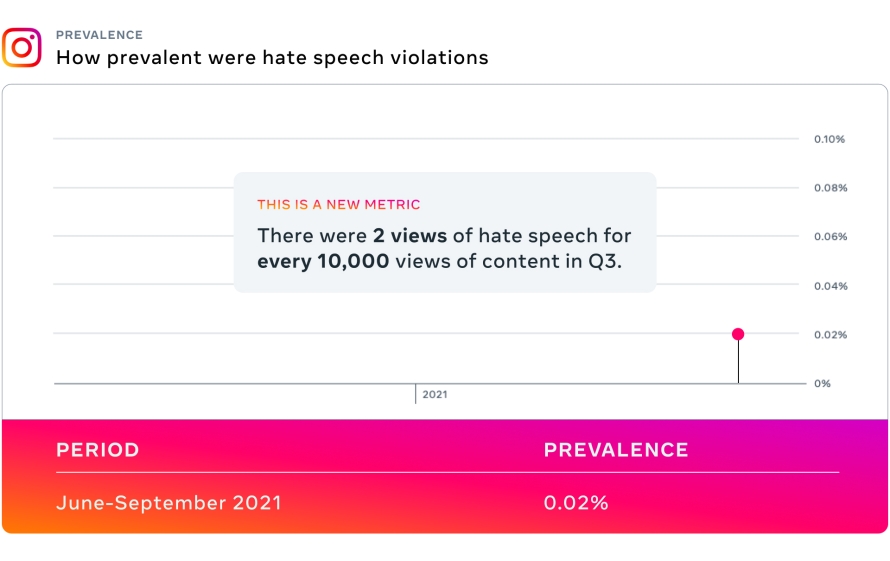

- 今回新たに、FacebookとInstagramにおけるいじめと嫌がらせの表示頻度、Instagram上のヘイトスピーチの表示頻度、そして暴力と扇動に関する全ての指標を公開しました。

表示頻度の測定方法については、表示頻度の解説ページから確認することができます。 - Metaの指標が正しく測定、報告されていることを検証するため、本年度の第4四半期に第三者機関であるEY(アーンスト・アンド・ヤング)による監査*1を実施し、その結果を2022年の春に公開する予定です。

今回追加された新しい指標を含め、今期はFacebookの14のポリシー項目、Instragramの12のポリシー項目について報告します。このレポートでは、さらに以下の情報を併せて公開します。

- 2021年第3四半期の広範囲に閲覧された米国のコンテンツに関するレポート*1とコンパニオン・ガイド*1

- 2021年第2、第3四半期の監督委員会による四半期レポート*1

- その他、2021年度上半期の透明性レポート

Metaは、7月に初めて2021年第1四半期に関する監督委員会による毎四半期のレポートを公開しました。このレポートでは、当社が委員会に報告した事例の詳細と、委員会からの勧告に対する当社の回答、および委員会が下した決定について公開しています。今後これらの情報は、各四半期のコミュニティ規定施行レポートに加える予定です。

なお、これらのレポートは全て透明性センター*1に公開しています。

コミュニティ規定施行レポートに関するハイライト

Facebookにおけるヘイトスピーチの表示頻度は、4四半期連続で低下し続けています。第2四半期の0.05%(コンテンツの閲覧1万件につき5件)から、第3四半期は0.03%(コンテンツの閲覧1万件につき3件)に減少しています。パーソナライゼーションの改善など、Metaの技術の向上とニュースフィード上の問題のあるコンテンツを減らす表示の優先順位の変更により、ヘイトスピーチの数を継続して減少させることができました。

今回のレポートでは、初めてInstagramにおけるヘイトスピーチの表示頻度を公開しました。第3四半期におけるInstagramでのヘイトスピーチの表示頻度は0.02%でした。

第3四半期では、Facebookにおける暴力と扇動に関するポリシーに違反するコンテンツの表示頻度は0.04~0.05%(コンテンツの閲覧1万件につき4~5件)、Instagramでは0.02%(コンテンツの閲覧1万件につき2件)でした。Facebook上から削除した、暴力と扇動に関するポリシーに違反するコンテンツは1,360万件で、うち96.7%は報告を受ける前に事前に検知しました。Instagramでは同様のコンテンツを330万件削除し、事前対応率は96.4%でした。暴力と扇動に関するポリシー違反として削除する可能性があるコンテンツには、誰かが暴力を振るうことを擁護したり、暴力行為を扇動するようなコンテンツが含まれます。このようなコンテンツは性質上、有害である可能性があることから、単なるいたずらであるかどうか明らかでないコンテンツであっても、安全性を保つために削除します。その対象には、武器を使用して人を傷つける方法を教えるような深刻なものから、友人に冗談で「殺してやる!」と言っているものまで、様々なコンテンツが含まれます。必要に応じて、身体的な危害や公共の安全に対する直接的な脅威があると判断した場合には、法執行機関と協力します。

第3四半期では、Facebookにおけるいじめと嫌がらせに関するコンテンツの表示頻度は0.14~0.15%(コンテンツの閲覧1万件につき14~15件)、Instagramでは0.05~0.06%(コンテンツの閲覧1万件につき5~6件)でした。Facebook上から削除したいじめと嫌がらせに関するコンテンツは920万件で、事前対応率は59.4%でした。Instagramでは、同様のコンテンツを780万件削除し、事前対応率は83.2%でした。いじめと嫌がらせに対する対応は、独特なチャレンジが要求されるものであり、その判断には文脈がを考慮することが重要であることから、最も複雑な問題の一つです。詳細についてはいじめと嫌がらせの表示頻度を下げる取り組み*1をご覧ください。

有害なコンテンツの抑制に関する取り組み

Metaは、世界中の何百万ものコンテンツを日々レビューするためにポリシーを拡大し、審査が必要なコンテンツを検知し、優先順位をつけるために、テクノロジーを利用しています*1。私たちは70以上の言語でコンテンツのレビューを行うコンテンツレビューチームや、50以上の言語でヘイトスピーチのレビューを行うAI(人工知能)を有しています。また、強化学習による整合性オプティマイザー(RIO)*1やWPIE*1 、 XLM-R*1といった、言語やコンテンツの種類を問わず有害なコンテンツをより早く特定するテクノロジーの構築を続けてまいります。これらの取り組みとAI(人工知能)研究に引き続き注力することで、Metaのテクノロジーは急速に拡大し、プラットフォームを安全に保ちます。紛争状態にある、もしくはそのリスクのある国*1には、数年にわたって投資を行い、地域社会と協力するチームをつくり、ポリシーを策定し、技術を向上させ、現実の問題に対応しています。

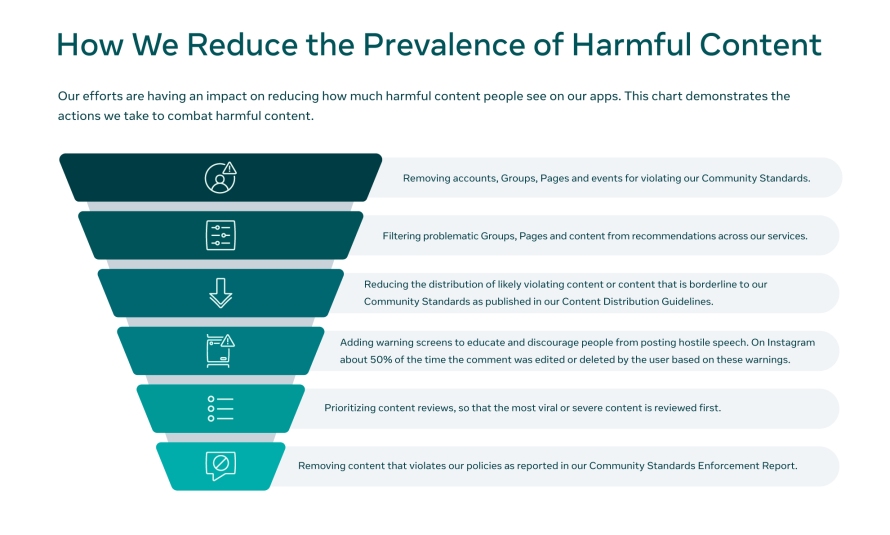

私たちは、ポリシー違反のコンテンツ検知やポリシーの改善、ニュースフィード上の問題のあるコンテンツの抑制など、様々な方法で有害なコンテンツの表示頻度を減らしています。これらの措置によって、Facebookにおけるヘイトスピーチの表示頻度をこの1年間で半分以下に低減することができました。また、暴力と扇動、いじめと嫌がらせなどのポリシー項目においても同様の措置を講じています。言語やニュアンス、文化的な背景への理解が求められるヘイトスピーチ、いじめや嫌がらせ、暴力と扇動への対応を強化するため、新しい課題横断的なAIシステム*1を導入し、学習内容を統合することでより効果的にポリシー違反に対処できるようになりました。

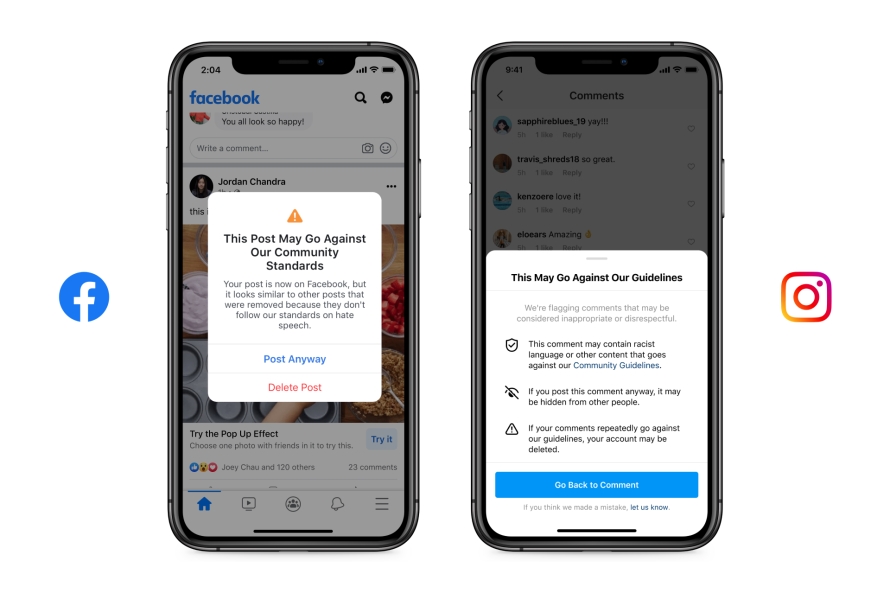

また米国などでは、いじめや嫌がらせなどの悪意のある発言を含む、コミュニティ規定に違反する可能性があるコンテンツには、投稿に注意を促すため警告画面を表示しています。この画面は、投稿やコメントをした際に表示され、コミュニティ規定に違反する可能性があることを示し、そのコンテンツは非表示にされたり、表示頻度を減らされることがあることを通知します。同様のコンテンツが繰り返し投稿された場合、その利用者のアカウントは停止、もしくは削除される場合があります。

今後の展望

有害コンテンツは様々な形で存在しますが、当社がプラットフォームを安全に保つための取り組みも同様です。MetaはFacebook、Instagram、Messenger、WhatsAppのプロダクトチームにとどまらず、今後数年間でメタバースを構築していくすべてのチームにインテグリティチームを組み込み、プラットフォームの安全を保つための取り組みを強化してまいります。プロダクトチームは、新しいプロダクト*1を開発し発表する際に、プラットフォームの安全性の問題*1について取り組んでいますが、これには安全性の高いメタバースの構築も含まれます。

また、Metaは研究にも注力しており、学術研究者向けに設計されたAPIのFacebookオープンリサーチと透明性(FORT)の早期アクセスプログラム*1を公開し、プラットフォーム上のデータへの安全なアクセスを可能にしました。

全ての有害コンテンツを完全に特定することはできませんが、私たちは改善に向けた取り組みを常に続け、より多くの有用なデータを共有し、研究に基づく意思決定を続けてまいります。

*1 英文のみで公開しています