Facebook社はこのたび、コミュニティ規定施行レポートの第8版(日本語版 Facebook, Instagram)を公開します。今回のレポートでは、2020年第4四半期(10月から12月まで)におけるポリシーの施行状況に関連する指標を提供しており、Facebookが掲げる12のポリシーと、Instagramが掲げる10のポリシーに関する指標に則っています。

コミュニティ規定施行レポートに関するハイライト

第3四半期(7月から9月まで)では初めて、Facebook上でヘイトスピーチに関するコンテンツが表示された利用者の割合を示す指標であるヘイトスピーチの表示頻度(プレヴァレンス)を公開しました。今四半期におけるヘイトスピーチの表示頻度は、前回の0.10%~0.11%から0.07%~0.08%に低下し、件数で言えばコンテンツの閲覧1万件ごとのヘイトスピーチの閲覧数は7~8件に減少しました。暴力的で過激なコンテンツの比率も0.07%から0.05%に低下し、成人のヌードと性的行為に関するコンテンツは0.05%~0.06%から0.03%~0.04%に低下しました。

表示頻度の改善は、主にニュースフィード上で違反コンテンツを減らすために行った変更によるものです。各投稿の内容は、Facebook社のポリシーに違反する可能性の高さをはじめとする正当性シグナルと、アンケートへの回答及び非表示や報告といったプラットフォーム上における利用者のアクティビティから受け取るシグナルなどの組み合わせを考慮したプロセスによってランク付けされています。これらのシグナルの使用方法を改善することで、個々の利用者の好みに合わせてニュースフィードを表示することができ、また、後にポリシーに違反していると判断される可能性のある投稿の表示回数を減らすことができます。

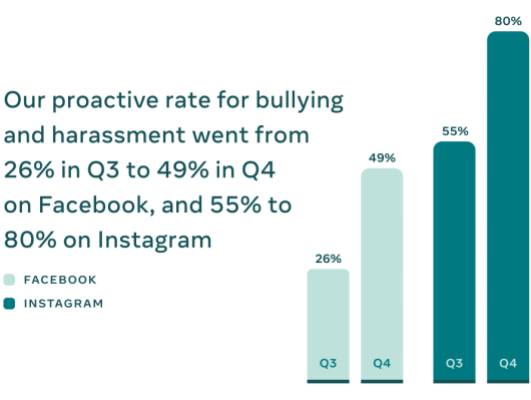

利用者から報告を受ける前にFacebook社が対処したコンテンツの割合を示す事前対応率は、特定の問題となるコンテンツ、特にいじめや嫌がらせに関する分野で改善が見られました。いじめや嫌がらせに対する事前対応率は、Facebookでは、第3四半期の26%から49%に、Instagramでは55%から80%へ上昇しました。ヘイトスピーチやいじめ、嫌がらせなど、ニュアンスやコンテキストが重要な分野のAIを改善(英語のみ)することで、利用者の安全を守るための取り組みの規模を拡大することができました。

グローバルでコンテンツレビューを行う人員数は徐々に増加しているものの、ワクチンが普及するまでは、コンテンツレビューの水準は新型コロナウイルス感染症の影響を受けると予想されます。限られた人員の中でも、自殺や自傷行為などの有害コンテンツの審査を優先的に行っています。第4四半期におけるFacebook上で措置を講じたコンテンツの数は以下の通りです。

- 630万件のいじめといやがらせに関するコンテンツ(コメント検出技術の向上により、第3四半期に措置を講じたコンテンツ数350万件から増加)

- 640万件の組織化されたヘイト行為に関するコンテンツ(第3四半期に措置を講じたコンテンツ数400万件から増加)

- 2,690万件のヘイトスピーチに関するコンテンツ(アラビア語・スペイン語・ポルトガル語のコメント検出技術の向上により、第3四半期に措置を講じたコンテンツ数2,210万件から増加)

- 250万件の自殺と自傷行為に関するコンテンツ(第3四半期に措置を講じたコンテンツ数130万件から増加)

第4四半期におけるInstagram上で措置を講じたコンテンツの数は以下の通りです。

- 500万件のいじめと嫌がらせに関するコンテンツ(コメント検出技術の向上により、第3四半期に措置を講じたコンテンツ数260万件から増加)

- 30.8万件の組織化されたヘイト行為に関するコンテンツ(第3四半期に措置を講じたコンテンツ数22.4万件から増加)

- 660万件のヘイトスピーチに関するコンテンツ(第3四半期に措置を講じたコンテンツ数650万件から増加)

- 340万件の自殺と自傷行為に関するコンテンツ(コンテンツレビュアーの復帰により、第3四半期に措置を講じたコンテンツ数130万件から増加)

2021年の展開について

Facebook社は本年中に、Instagramで追加の指標を公開し、Facebookでポリシーに新たな領域を追加する予定です。また、これらのレポートをより多くの利用者に情報開示にすることで、ポリシーの施行に関するデータをわかりやすくお伝えできるよう努めています。Facebook社の目標は、透明性においてテクノロジー業界をリードすることであり、この取り組みの一環として、今後もさらなるポリシーの施行に関する指標を公開していきます。また、どのビジネスも自社の課題を独自で評価すべきではないという考えに基づき、昨年は、コンテンツ管理システムの独立した第三者機関による監査(英語のみ)の実施について発表し、公開した数値を検証することを定め、本年よりこのプロセスを開始します。

Facebook社はファミリーアプリ上の有害なコンテンツを削除するために、テクノロジーやコミュニティ規定の施行に関する取り組みを継続的に改善していきます。