多くの人がFacebookグループを利用して、他の利用者と興味・関心を共有しながらつながっています。Facebookグループがプライベートグループとして作成された場合でも、他のすべての利用者や公開グループと同じようにルールを守る必要があります。

Facebookのコミュニティ規定は、公開グループとプライベートグループの両方に適用され、これらのグループを対象に事前検知技術によるモニタリングを行っており、利用者からの報告の前に、ルールに違反している可能性があるコンテンツをAIによって検出(英語のみ)し、自動的に削除しています。今回は、有害なコンテンツや誤情報を低減させるための数多くの変更を含め、グループを安全に保つための継続的な取り組み(英語のみ)に関する最新情報をお伝えします。

昨年1年間で、ポリシーの「危険な人物および団体」の項目に違反したとして、Facebookが削除したグループのコンテンツの数はおよそ150万件にのぼり、そのうちの91%は利用者からの報告の前に検知され、措置が講じられています。また、ヘイトスピーチに関するポリシーに違反したとして、約1200万件のコンテンツをグループから削除しましたが、その87%は利用者からの報告の前に検知し削除したものでした。

以上がグループ内の投稿に対して私たちが行っている取り組みです。また、グループ自体がルール違反を繰り返したり、規定を違反する意図で作成されている場合は、グループそのものを削除します。昨年、これらのポリシーに違反した100万以上のグループを削除しています。

違反を繰り返す利用者への措置

コミュニティ規定への違反を繰り返す利用者がグループを新規作成できないようにするため、今後もさらに厳しい措置を講じます。既存の再犯防止ポリシー(英語のみ)では、グループの管理者が私たちによってこれまでに削除されたグループに類似したグループを作成することは禁じられています。また、ポリシー違反によって削除されたグループの管理者とモデレーターは、一定期間すべてのグループの新規作成ができなくなります。

グループ内でコミュニティ規定に違反する内容の投稿をしたメンバーについては、その後30日間、そのグループへの投稿には承認が必要になります。管理者やモデレーターがその投稿を承認するまで、他の人に表示されることはありません。管理者やモデレーターがコミュニティ規定に違反する投稿を繰り返し承認した場合、そのグループは削除されます。

グループの管理者による有意義なコミュニティづくりへの支援

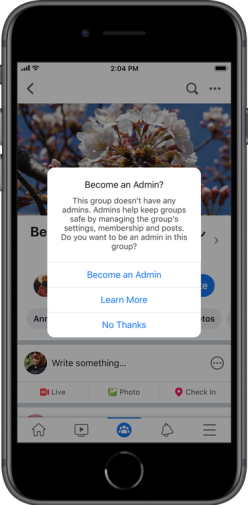

グループの管理者は、グループの目標とカルチャーを育成するリーダーのような存在となりますが、時には管理者が辞任したりグループを退会したりする場合もあります。このような管理者が不在になったグループも引き続き事前検知技術によるコンテンツへの措置の対象となりますが、Facebook社は有益なコミュニティづくりには率先して活動する管理者の存在が重要だと考えています。こうしたグループが有意義なコミュニティを維持する管理者を任命できるように、管理者のポジションに関心がありそうなメンバーに管理者の役割を提案する試みを行っています。この提案の際には多くの要素が考慮されており、コミュニティ規定への違反履歴もそのひとつです。

数週間以内に、一定期間にわたり管理者がいないグループのアーカイブを開始します。今後は、現行の管理者が辞任する際に他のメンバーを新たな管理者に打診できるようになり、打診されたメンバーが引き受けない場合は、Facebookが管理者のポジションに関心が高そうなメンバーに管理者になるよう提案します。誰も管理者の役割を引き受けなかった場合、そのグループはアーカイブされます。

医療関連のグループをおすすめから除外

医療関連のグループをはじめ、Facebookグループは困難な状況下で利用者が支え合うための有意義な場となります。同時に、信頼のおける情報源から医療関連の情報を入手することが極めて重要です。健康に関する正確な情報を利用者に提供することを優先させるために、今後は医療関連のグループをおすすめに表示しません。ただし、利用者が医療関連のグループに友達を招待したり、検索することは可能です。

グループを含むおすすめコンテンツの種類について、詳しくは最近公開(英語のみ)されたおすすめに関するガイドラインをご覧ください。

暴力に関連する組織や運動への対策

今年の夏、Facebook社は暴力に関連するグループへの継続的な措置を講じました。米国に拠点を置く危険な組織とみなされた暴力的な反政府ネットワークに関連する106のグループ(英語のみ)を削除しました。 また、陰謀論を拡散するQAnonや米国を拠点とする民兵組織、抗議活動の中で暴力行為を支持する無政府主義者団体など、公共の安全を脅かす重大なリスクが明らかになっている組織や運動にも対応するようポリシーを拡大しました。こうしたコンテンツをおすすめに表示せず、ニュースフィード上での表示の優先順位を引き下げ、検索制限の対象とすることで拡散を防いでいます。また、暴力に発展し得る議論を行っていると判断したグループは完全に削除しており、これには遠回しな暴力の表現や記号の使用なども含まれます。このポリシーの下、QAnonに関連する790のグループを削除(英語のみ)しています。

グループが拡散する誤情報への対策

Facebook上で拡散される誤情報に対応するために、独立したファクトチェッカーのグローバルネットワークを活用した「削除、抑制、情報提供(Remove,Reduce,Inform)(英語のみ)」という対策を実施しています。Facebookグループでは次のような取り組みを行っています。

- コミュニティ規定に違反したコンテンツをシェアしたグループの削除:管理者やモデレーターがFacebookのルールに違反するコンテンツを繰り返し投稿または承認した場合、そのグループそのものを削除します。

- 誤情報をシェアしたグループの配信を抑制する: ファクトチェッカーによって虚偽と判断されたコンテンツを繰り返しシェアしたグループは、Facebook利用者のおすすめに表示されなくなります。また、こうしたグループのすべての投稿について、ニュースフィード上での表示の優先順位の引き下げや、通知を制限し、投稿を目にする利用者を少なくなるようにします。

- 誤情報を見つけたら利用者に知らせる: Facebookでは、ファクトチェッカーが確認したコンテンツにラベルを付け、背景情報を確認できるようにしています。利用者がコンテンツをシェアしようとする際、また、シェアしたものが後で誤情報と分かった場合に通知を行っています。グループにフェイクニュースが投稿された場合、グループ管理者に通知され、グループのクオリティで概要を確認できます。

Facebook上でグループを安全に保つには、さらに多くの対策が必要であると考えています。Facebook社は今後も、グループが人々がつながり、支え合う場であり続けるために、技術とポリシーの改善に努めてまいります。