Dans les prochaines semaines, Instagram commencera à notifier les parents utilisant la supervision parentale si leur adolescent tente à plusieurs reprises de rechercher des termes liés au suicide ou à l’automutilation sur une courte période. Il s’agit de la dernière mesure de protection en date déployée par le groupe en lien avec les Comptes Adolescents et les outils de supervision parentale d’Instagram.

Nous comprenons à quel point ces sujets sont sensibles et combien recevoir une telle alerte peut être éprouvant pour un parent. La grande majorité des adolescents ne recherchent pas ce type de contenus sur Instagram et, lorsqu’ils le font, notre politique consiste à bloquer ces recherches et à les orienter vers des ressources et lignes d’écoutes appropriées. Ces alertes visent à informer les parents si leur adolescent tente de rechercher ce type de contenu de manière répétée, afin de leur donner les moyens de le soutenir.

Comment fonctionnent les alertes ?

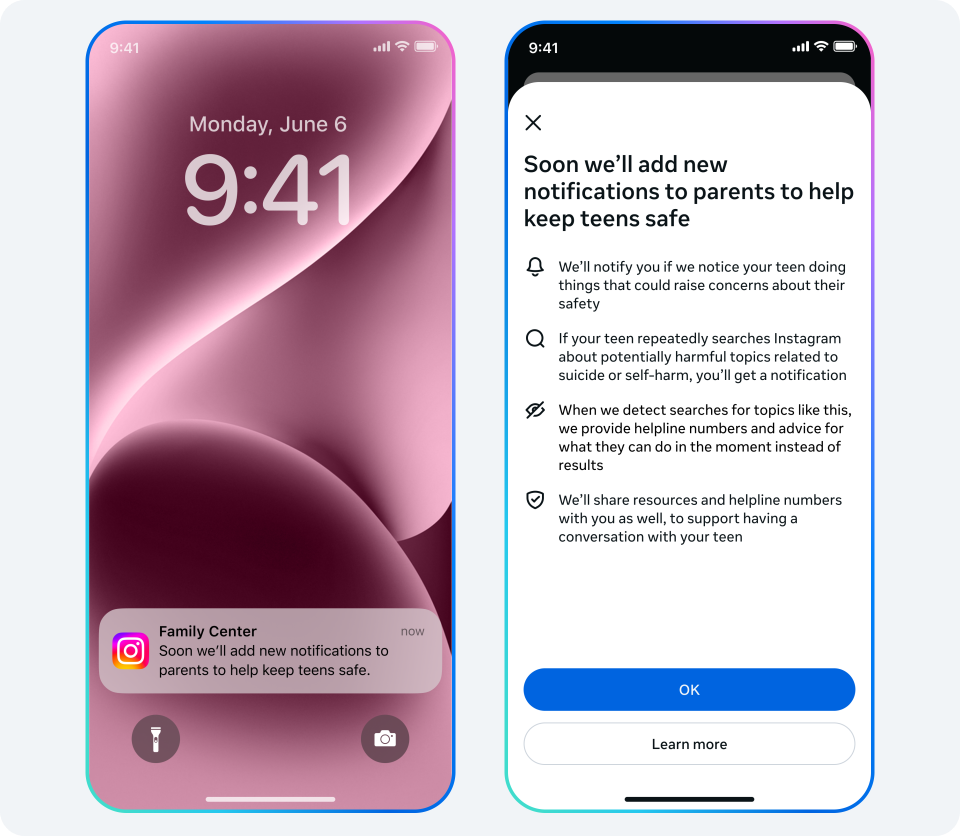

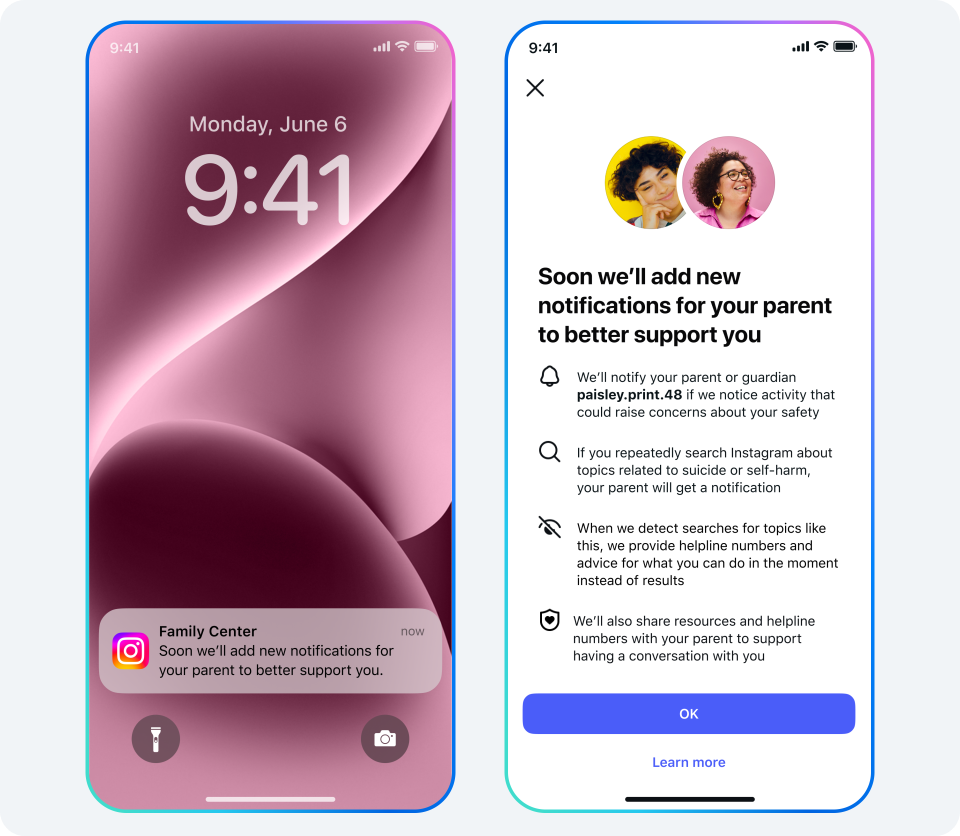

A partir de la semaine prochaine, parents et adolescents utilisant la supervision parentale seront informés qu’Instagram commencera à envoyer ces nouvelles alertes aux parents, sur la base de l’activité de recherche de leur adolescent. Les recherches pouvant déclencher une alerte incluent : des phrases faisant la promotion du suicide ou de l’automutilation, des formulations suggérant qu’un adolescent souhaite se faire du mal, ainsi que l’usage de termes comme « suicide » ou « automutilation ».

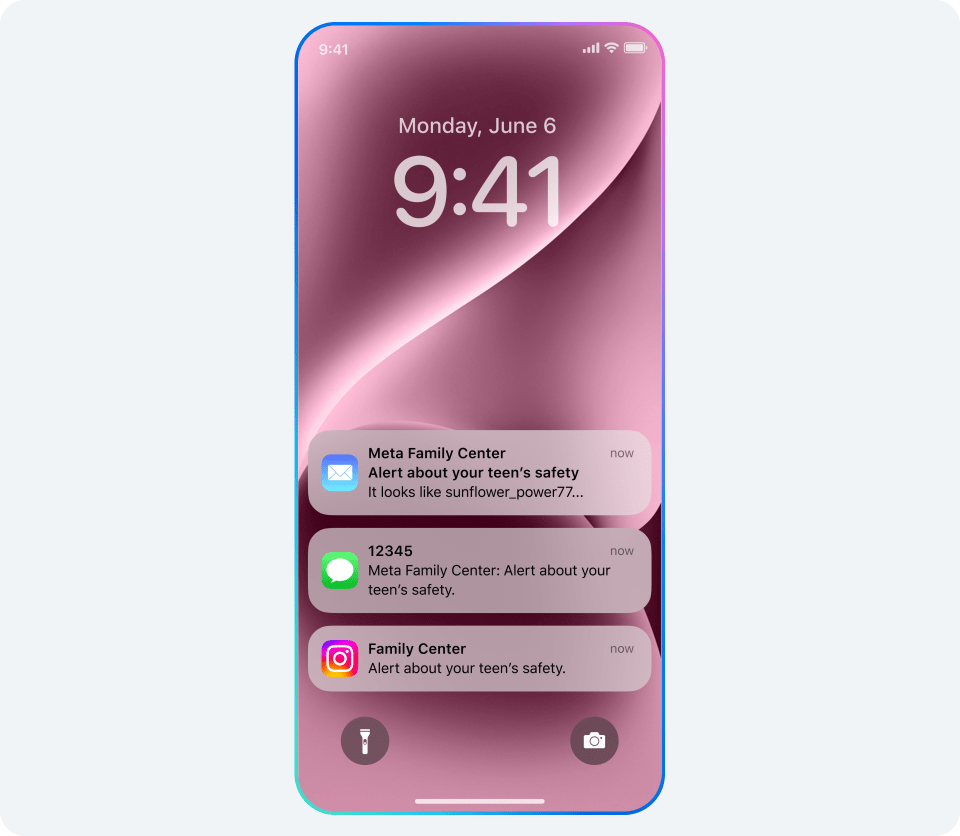

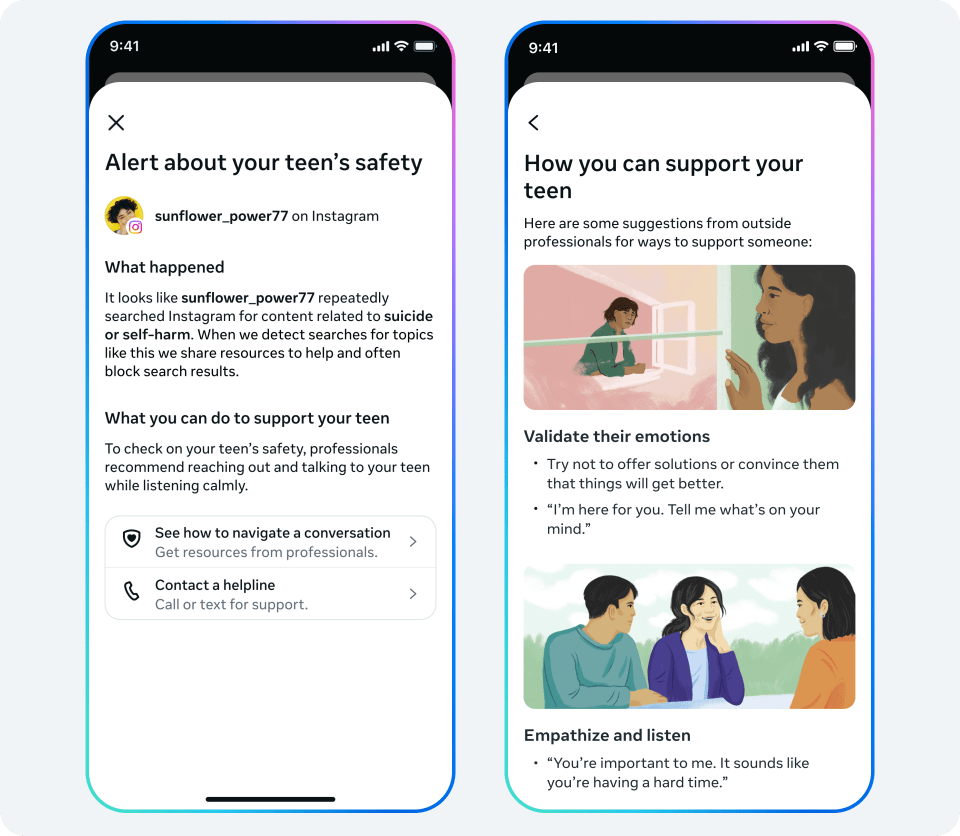

Les alertes seront envoyées aux parents par e-mail, SMS ou WhatsApp selon les coordonnées indiquées lors de leur inscription, ainsi que via une notification dans l’application. En cliquant dessus, ils verront alors un message expliquant que leur adolescent a tenté à plusieurs reprises de rechercher des termes associés au suicide ou à l’automutilation. Ils seront également redirigés vers des ressources d’experts pour les aider à aborder ces discussions sensibles.

Ces alertes seront déployées à partir de la semaine prochaine pour les parents utilisant les outils de supervision aux États-Unis, au Royaume-Uni, en Australie et au Canada, puis dans d’autres régions plus tard cette année.

Trouver le bon équilibre

Notre objectif est de permettre aux parents d’intervenir si les recherches de leur adolescent suggèrent qu’il pourrait avoir besoin de soutien. Nous voulons également éviter d’envoyer ces notifications inutilement, car si elles sont trop fréquentes, elles risquent de perdre en pertinence.

Pour atteindre cet équilibre essentiel, nous avons analysé les comportements de recherche sur Instagram et consulté des experts de notre Suicide and Self-Harm Advisory Group. Nous avons retenu un seuil qui nécessite plusieurs recherches dans un laps de temps court, tout en privilégiant la prudence. Cela signifie que nous pourrions parfois notifier des parents sans qu’il y ait de réel motif d’inquiétude, mais nous estimons, et les experts sont d’accord, qu’il s’agit du bon point de départ. Nous continuerons à suivre la situation et à écouter les retours afin de nous assurer que le dispositif reste adapté.

Selon le Dr Sameer Hinduja, co-directeur du Cyberbullying Research Center :

« Lorsqu’un jeune effectue des recherches sur le suicide ou l’automutilation, permettre à un parent d’intervenir peut être extrêmement important. Le fait que Meta ait désormais intégré cette fonctionnalité constitue une avancée significative et correspond au type d’évolution que les experts en protection de l’enfance appellent de leurs vœux depuis longtemps. »Vicki Shotbolt, directrice générale de Parent Zone, a déclaré :

« Il est essentiel que les parents disposent des informations nécessaires pour soutenir leurs adolescents. C’est une étape vraiment importante qui devrait contribuer à rassurer davantage les parents : si leur adolescent cherche activement ce type de contenus préjudiciables sur Instagram, ils en seront informés. »

Renforcer les protections existantes

Ces alertes s’inscrivent dans la continuité de notre travail existant visant à protéger les adolescents contre les contenus potentiellement préjudiciables sur Instagram. Nous appliquons des règles strictes contre les contenus qui encouragent ou glorifient le suicide ou l’automutilation et, bien que nous autorisions les personnes à partager du contenu sur leurs propres difficultés liées à ces sujets, nous masquons ce contenu aux adolescents, même s’il est publié par une personne qu’ils suivent.

Nous travaillons à bloquer les recherches de termes clairement liés au suicide et à l’automutilation, y compris ceux qui violent nos politiques sur le suicide et l’automutilation. Cela signifie que nous n’affichons aucun résultat et orientons plutôt les personnes vers des ressources et des organisations locales pouvant les aider. Nous orientons également nos utilisateurs vers des ressources et des lignes d’assistance lorsque leurs recherches ne sont pas directement liées au suicide ou à l’automutilation, mais concernent la santé mentale de manière plus générale. Nous continuons à alerter les services d’urgence lorsque nous prenons connaissance d’un danger imminent pour nos utilisateurs. Des actions qui ont permis de sauver des vies.

Nous lançons, dans un premier temps, ces alertes sur la recherche Instagram, mais nous savons que les adolescents se tournent de plus en plus vers l’IA pour obtenir du soutien. Bien que notre IA soit déjà formée pour répondre de manière sécurisée aux adolescents et fournir, le cas échéant, des ressources sur ces sujets, nous développons désormais des alertes parentales similaires pour certaines expériences en lien avec l’IA. Celles-ci informeront les parents si un adolescent tente d’engager certains types de conversations liées au suicide ou à l’automutilation avec notre IA. Il s’agit d’un travail important, et nous aurons davantage d’informations à partager dans les mois à venir sur ce sujet.