Nos services en arrière-plan comme la personnalisation, la recommandation et l’ordre d’affichage sont alimentés par l’intelligence artificielle (IA). Ils offrent une expérience fluide et sur mesure aux personnes qui utilisent nos produits et nos services. Mais le fonctionnement de l’IA et ses avantages peuvent être difficiles à comprendre, tout spécialement par les utilisateurs et les utilisatrices au quotidien. C’est justement ce que nous avons à cœur de changer.

Chez Meta, nous savons qu’il est important de fournir des outils et des ressources permettant de comprendre la manière dont l’IA façonne les expériences produit. C’est pourquoi nous avons pris l’engagement de faire de la transparence et du contrôle l’un de nos cinq piliers pour une IA responsable. L’une des voies que nous explorons pour faciliter l’explication de l’IA repose sur la documentation des modèles et du système. Aujourd’hui, nous franchissons une nouvelle étape dans ce cheminement en publiant un prototype d’outil de carte de système pour l’IA, conçu pour mieux expliquer le fonctionnement de l’IA et l’architecture sous-jacente de ses systèmes.

Ébauchant les différents modèles qui composent un système d’IA, cette toute première carte aide à mieux comprendre la manière dont ces systèmes fonctionnent, sur la base de l’historique, des préférences et des paramètres individuels, entre autres. La carte de système pilote que nous avons créée, et que nous continuons de tester, porte sur l’ordre du fil Instagram, qui consiste à prendre les publications non encore vues des comptes suivis par une personne et d’établir un ordre d’affichage en fonction de la probabilité qu’elles suscitent son intérêt.

Développement de nouveaux outils permettant d’expliquer l’IA encore plus en profondeur

La possibilité d’expliquer plus facilement l’IA passe par un dialogue transversal à travers tous les secteurs et disciplines. Les entreprises, les autorités chargées de la réglementation et les universitaires testent actuellement différentes manières d’améliorer la communication autour de l’IA et son fonctionnement, à travers différents types d’orientation et de recommandations, visant à améliorer les connaissances du grand public en matière d’IA.

Au vu de la complexité des systèmes d’IA, il est à la fois important et extrêmement difficile de développer une documentation répondant systématiquement aux besoins de transparence et de simplicité exprimés par le public. À ce titre, les fiches de données, les cartes modèles, les cartes de système et les fiches d’information sont conçues pour des audiences différentes. Nous nous attachons à ce que les cartes de système puissent être comprises aussi bien par les spécialistes que par les novices, et qu’elles puissent fournir une vue unique et approfondie du monde très complexe de l’interface entre les systèmes d’IA et l’homme d’une manière reproductible et évolutive pour Meta. La création d’un cadre techniquement précis, capable de capter les nuances de fonctionnement des systèmes d’IA à l’échelle de Meta tout en étant facile à assimiler par l’utilisateur ou utilisatrice de nos technologies, repose sur un équilibre délicat. Et à plus forte raison sachant que nous faisons sans cesse progresser l’état de la technique dans ce domaine.

Avec le lancement de cette carte de système pour l’IA, d’itération en itération, nous espérons identifier et constamment améliorer les éléments des systèmes d’IA qui doivent être abordés. Nous le ferons avec les bons modes d’intervention et auprès des bonnes audiences, via des outils externes simples et faciles à assimiler.

Les cartes de système : une première étape

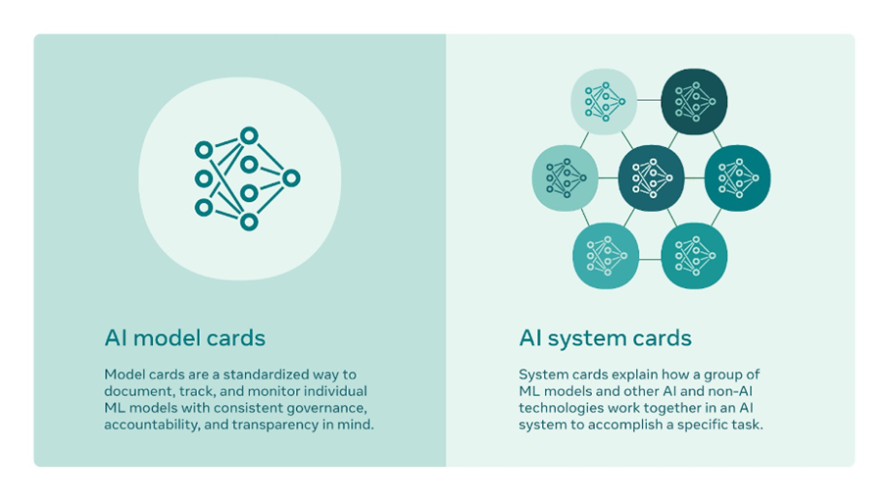

La plupart des modèles de machine learning (ML) sont compris dans un système d’intelligence artificielle plus vaste, un groupe de modèles de ML, de technologies d’IA et d’autres types qui fonctionnent ensemble pour réaliser des tâches spécifiques. Parce que les modèles de ML ne parviennent pas toujours à générer des résultats en travaillant isolément et qu’ils peuvent interagir différemment selon les systèmes dans lesquels ils sont compris, les cartes modèles, qui sont un standard de modèle de documentation largement accepté, n’offrent pas un aperçu exhaustif de ce que font les systèmes d’IA. Par exemple, nos modèles de classification d’image sont tous conçus pour prédire le contenu d’une image donnée. Mais ils peuvent être utilisés différemment dans un système axé sur l’intégrité, dont la mission est de signaler le contenu nuisible, ou encore dans un système de recommandation chargé de montrer aux personnes les publications susceptibles de les intéresser.

Après consultation de spécialistes externes, aux États-Unis et dans le reste du monde, l’équipe de Meta responsable de l’IA a choisi d’explorer les cartes de système en tant qu’approche initiale pour étudier globalement les systèmes d’IA, plutôt que chaque modèle un par un. Les retours des experts consultés par l’équipe ont permis de consolider cette approche, en mettant l’accent sur l’importance de comprendre différents aspects de l’utilisation des résultats d’un modèle. C’est-à-dire qu’ils peuvent être utilisés dans un produit à part entière, ou intégrés à d’autres modèles ; il faut aussi comprendre lesquelles de nos politiques s’appuient sur leur utilisation et quel impact ces résultats produisent sur les groupes de personnes utilisant un produit ou service fondé sur l’intelligence artificielle.

Pilote pour l’ordre d’affichage dans le fil Instagram

Lancé par l’équipe Instagram chargée de l’équité, ce projet pilote de carte de système s’appuie sur une introduction des cartes modèles précédemment élaborée par l’équipe et progressivement déployée par Meta. Véritable moteur initial de cette initiative, les modèles d’Instagram ont constitué un cas bien documenté qui nous a permis d’illustrer le fonctionnement réel de nos systèmes, en nous permettant de dévoiler ici une carte de système d’IA, et d’expliquer comment le système de classement dans le fil basé sur l’IA fonctionne de manière dynamique pour offrir une expérience personnalisée.

Limites des cartes de système et itération continue

Si les cartes de système permettent d’expliquer le fonctionnement des systèmes d’IA dans un format facile à assimiler, elles présentent malgré tout quelques limites. Au fil de notre travail, nous avons pu en relever quelques unes :

Les cartes de système ne sont pas définitives : les systèmes d’IA apprennent et évoluent en permanence.

Les systèmes d’IA sont conçus pour apprendre et changer sans cesse, ce qui requiert des mises à jour constantes. De plus, de nombreux systèmes de Meta ne reposent pas que sur l’IA. L’intervention humaine entre également en jeu. Même dans ce cas, une seule et même carte de système ne peut pas offrir le même degré de pertinence pour tout le monde parce que nous continuons à tester de nouvelles expériences pour nos utilisateurs et utilisatrices. Pour y remédier, nous allons par exemple explorer l’horodatage, informant le public de la date de la dernière mise à jour des cartes de système.

Les informations techniques peuvent s’avérer difficiles à simplifier et le paysage change en temps réel.

Nos modèles ne fonctionnent pas en vase clos. Pendant que nous travaillons à offrir plus de transparence sur leur fonctionnement, ils ne cessent d’évoluer. Notre objectif consiste ici à faciliter la compréhension des principes qui sous-tendent la reconnaissance et les recommandations dans nos systèmes, plutôt que d’offrir un guide sur comment réussir, ou de présenter les règles en vigueur sur la plateforme. Il est extrêmement complexe de transposer des informations très techniques dans un registre standard, compréhensible par le plus grand nombre, sans renoncer à la précision. L’ajout ou la suppression d’un seul mot ou d’une seule phrase dans une explication technique pourrait la compromettre ou l’invalider. Et étant donné la présence de Meta à l’échelle mondiale, il nous faut également tenir compte de la barrière de la langue et de la traduction, en plus des différences dans le sens d’un terme ou code technique introduites par une explication simplifiée.

La prise en compte nécessaire des conséquences imprévues.

La technologie sur laquelle reposent nos systèmes demeure fondée sur l’intervention humaine. Et nous devons continuer à garantir que tout est mis en œuvre pour que les systèmes soient les plus justes possibles. Lors de l’introduction des cartes modèles par Instagram, l’objectif principal était de mettre en place un ensemble de vérifications au fil du processus, pour veiller à ce que les équipes réfléchissent bien aux conséquences imprévues de leurs lancements, avant qu’elles ne viennent réellement affecter la communauté.

La transparence et la sécurité sont parfois difficiles à conjuguer.

Révéler en détail le fonctionnement de certains systèmes d’IA pourrait compromettre les systèmes de sécurité ou ouvrir la voie à des attaques adverses, et donc porter potentiellement préjudice aux personnes qui utilisent nos produits. Si elles fournissent trop d’informations, nos cartes de système courent le risque d’offrir à des personnes malveillantes suffisamment de connaissances pour s’adonner à la rétro-ingénierie. Mais d’un autre côté, il est important pour nous d’informer nos utilisateurs et utilisatrices sur le fonctionnement de nos systèmes d’IA. Nous cherchons donc à atteindre le bon équilibre en matière de transparence.

Et maintenant ? L’avenir de la transparence de l’IA chez Meta

Les cartes de système peuvent constituer une étape importante dans notre démarche d’explication de ce que la transparence de l’IA veut dire à l’échelle de Meta. Au fur et à mesure de l’évolution du secteur et des discussions sur la documentation et la transparence du modèle, nous continuerons à définir d’autres pilotes pour faire progresser notre approche au fil du temps. Il s’agit pour nous de refléter les changements du produit, l’évolution des standards du secteur et des attentes en matière de transparence de l’IA.

Pour en savoir plus, vous pouvez consulter cet article technique sur la recherche ayant abouti aux cartes de système.