- A prevalência de conteúdos prejudiciais no Facebook e no Instagram permaneceu relativamente consistente – e diminuiu em algumas de nossas políticas, principalmente devido à melhoria e expansão da nossa tecnologia de detecção proativa.

- Estamos compartilhando os resultados da avaliação independente da EY do nosso relatório do quarto trimestre de 2021, para garantir que estamos calculando e relatando as nossas métricas com precisão.

Hoje, estamos publicando nosso Relatório de Aplicação dos Padrões da Comunidade para o primeiro trimestre de 2022. Ele indica como aplicamos nossas regras entre janeiro e março de 2022, em 14 políticas no Facebook e 12 no Instagram. Também estamos compartilhando alguns outros relatórios em nossa Central de Transparência, incluindo:

- O Relatório de Conteúdo Amplamente Visualizado do primeiro trimestre de 2022.

- O Relatório Trimestral do Comitê de Supervisão, referente ao primeiro trimestre de 2022, no qual disponibilizamos atualizações relacionadas às nossas respostas para 55 recomendações emitidas pelo Comitê. Este relatório mostra que, em resposta às recomendações do Comitê, iniciamos duas novas revisões aprofundadas das nossas políticas, que provavelmente resultarão em reuniões do Fórum de Políticas para considerar algumas mudanças específicas. O material também traz mais detalhes sobre os novos projetos de pesquisa que desenvolvemos, tanto qualitativos quanto quantitativos, para entender melhor como podemos incorporar as opiniões das pessoas em nossos recursos e processos de revisão.

- Alguns relatórios referentes ao segundo semestre de 2021, sobre temas como: solicitações governamentais de dados de usuários, como estamos protegendo a propriedade intelectual, com que frequência nossos serviços foram interrompidos e quando tivemos que restringir conteúdos com base nas leis de um determinado país.

- Uma nova página de relatórios da Central de Transparência que torna os relatórios regulatórios específicos de cada país mais acessíveis.

Também estamos divulgando os resultados de uma avaliação independente da EY sobre os nossos relatórios de aplicação. No ano passado, solicitamos à EY a conferência das métricas do nosso Relatório de Aplicação dos Padrões da Comunidade, pois acreditamos que não devemos ser os responsáveis por avaliar a nossa própria tarefa de casa. A análise da EY concluiu que o cálculo das métricas foi elaborado com base em critérios específicos, e que elas foram estabelecidas de maneira justa em todos os materiais relacionados. À medida que continuamos a progredir com este relatório, também continuaremos trabalhando em diferentes maneiras de garantir que ele seja apresentado com precisão e verificado de forma independente.

Destaques do Relatório

A prevalência de conteúdos prejudiciais no Facebook e no Instagram permaneceu relativamente consistente, mas diminuiu em algumas de nossas políticas do quarto trimestre de 2021 até o primeiro trimestre de 2022.

No Facebook, no primeiro trimestre de 2022, agimos em:

- 1,8 bilhão de peças de conteúdo de spam, o que representou um aumento de 1,2 bilhão quando comparado ao quarto trimestre de 2021, graças às nossas ações em um pequeno número de usuários que fazem um grande volume de postagens.

- 21,7 milhões de peças de conteúdos de violência e incitação, um aumento de 12,4 milhões quando comparado ao quarto trimestre de 2021, devido ao aprimoramento e expansão da nossa tecnologia de detecção proativa.

No Instagram, no primeiro trimestre de 2022, agimos em:

- 1,8 milhão de peças de conteúdo relacionadas a drogas, representando um aumento de 1,2 milhão em relação ao quarto trimestre de 2021, por conta das atualizações feitas em nossas tecnologias de detecção proativa.

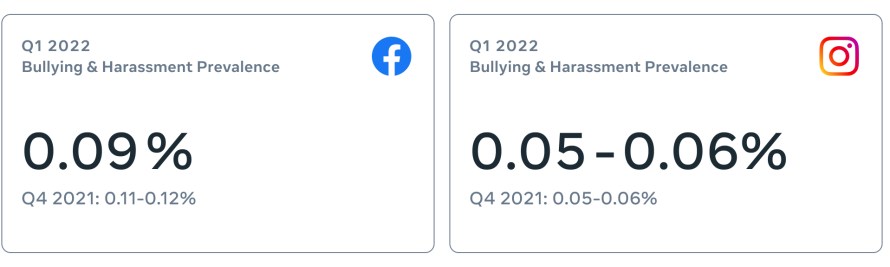

Também observamos um aumento na taxa de detecção proativa de conteúdos relacionados a bullying e assédio. De 58,8% do quarto trimestre de 2021, alcançamos 67% no primeiro trimestre de 2022, graças à melhoria e expansão da nossa tecnologia de detecção proativa. Também continuamos a ver uma pequena diminuição na prevalência no Facebook, de 0,11 – 0,12% no quarto trimestre de 2021 para 0,09% no primeiro trimestre de 2022.

Aprimorando nossas políticas e suas aplicações

Ao longo dos anos, investimos na criação de tecnologias que pudessem melhorar a forma como detectamos conteúdos prejudiciais. Com esse progresso, sabemos que erros serão cometidos e, por isso, tem sido igualmente importante investir, também, no aprimoramento de nossas políticas ao longo do caminho, além de melhorar nossa aplicação e as ferramentas que oferecemos aos usuários.

Por exemplo, melhoramos a nossa transparência ao longo dos anos, para que pudéssemos informar melhor às pessoas o motivo de removermos uma postagem e melhoramos a capacidade de contestação, para que as pessoas possam nos pedir uma nova análise das postagens. Também incluímos métricas relacionadas às apelações neste relatório. Recentemente, começamos a avaliar com mais profundidade a eficácia do nosso sistema de penalidades, por exemplo, testando o impacto dos avisos adicionais às pessoas antes de acionar sanções mais severas por violação das nossas políticas.

No ano passado, vimos como os aperfeiçoamentos de políticas podem garantir que não apliquemos medidas além do necessário. As atualizações que realizamos em nossa política de bullying e assédio levaram em conta linguagens que são normalmente incompreendidas quando fora de contexto. Os sistemas de aplicação também desempenham um papel importante: recentemente começamos a testar uma nova tecnologia de inteligência artificial que identifica e evita possíveis aplicações excessivas, aprendendo melhor com conteúdos apelados e posteriormente restaurados. Por exemplo, uma palavra que representa um insulto nos EUA também é um termo comum para dizer “cigarro” para os britânicos, o que não violaria nossas políticas. Também estamos testando diversas melhorias em nossa aplicação proativa, permitindo que alguns administradores de Grupos moldem melhor a cultura do seu espaço e levem em consideração o contexto sobre o que é e o que não é permitido ali; ou para refletir melhor o contexto em que as pessoas escrevem comentários entre amigos, onde às vezes brincadeiras bem-humoradas podem ser confundidas com conteúdo violador.

Olhando para o futuro

Por muito tempo, nosso trabalho se concentrou em medir e reduzir a prevalência de violação de conteúdo em nossos serviços. Mas trabalhamos com o mesmo afinco para melhorar a precisão das nossas decisões de aplicação de políticas. Embora a prevalência nos ajude a medir o que perdemos, também estamos trabalhando no desenvolvimento de métricas robustas em torno de erros cometidos, o que nos ajudará a entender melhor onde agimos incorretamente quanto ao conteúdo. Acreditamos que compartilhar as métricas de prevalência e precisão fornecerá uma visão mais completa do nosso sistema geral de fiscalização e nos ajudará a melhorar. Por isso estamos comprometidos em fornecer isso no futuro.

Por fim, à medida que novas regulamentações continuam a ser implementadas em todo o mundo, estamos focados nos deveres que elas criam para nós. Por isso, estamos aumentando e refinando processos e supervisionando muitas áreas do nosso trabalho. Isso nos permitirá fazer progressos contínuos em questões sociais, além de cumprir nossas obrigações regulatórias de forma mais efetiva.