Hoje, publicamos a quinta edição do nosso Relatório de Aplicação dos Padrões da Comunidade com métricas sobre como executamos nossas políticas de outubro de 2019 a março de 2020. Passamos os últimos anos construindo ferramentas, equipes e tecnologias para ajudar a proteger as eleições de interferências, evitar a disseminação de desinformação em nossos aplicativos e manter as pessoas protegidas de conteúdos nocivos. Então, quando a crise do COVID-19 surgiu, tínhamos as ferramentas e os processos estabelecidos para avançar rapidamente e pudemos continuar com a detecção e remoção de conteúdos que violavam as nossas políticas. Quando enviamos temporariamente nossos revisores de conteúdo para casa devido à pandemia do COVID-19, passamos a contar mais com sistemas automatizados e priorizamos conteúdos de alta gravidade para a revisão das nossa equipes, assim continuamos a manter nossos aplicativos seguros durante esse período.

Este relatório inclui dados até março de 2020, portanto não reflete o impacto total das mudanças que fizemos durante a pandemia. Antecipamos que o impacto dessas mudanças será visto em nosso próximo relatório e, possivelmente, além deste. Seremos transparentes sobre esses impactos. Por exemplo, nas últimas sete semanas, nem sempre conseguimos oferecer a opção de recorrer de decisões relativas a conteúdos em nossas plataformas e remoções de contas, portanto esperamos que o número de apelações seja muito menor em nosso próximo relatório. Também priorizamos a remoção de conteúdos nocivos ao invés de medir nossos esforços, então podemos não conseguir calcular a prevalência de conteúdos que contenham violações durante esse período. O relatório de hoje mostra o impacto dos avanços que fizemos em nossas tecnologias de detecção e remoção proativa de conteúdos violadores.

O que há de novo nesse relatório?

Estamos agora incluindo métricas em doze políticas no Facebook e em dez no Instagram. O relatório apresenta dados do Instagram em quatro áreas temáticas: Discurso de Ódio, Nudez Adulta e Atividades Sexuais, Violência e Conteúdo Explícito, e Bullying e Assédio. Pela primeira vez, também trazemos dados sobre apelações feitas em razão de medidas tomadas em conteúdos no Instagram, bem como o número de decisões que revogamos com base nessas apelações ou quando identificamos o problema proativamente. Também adicionamos dados sobre nossos esforços para combater o ódio organizado no Facebook e no Instagram. Você pode saber mais sobre esses esforços e o progresso que fizemos aqui.

Progresso em detectar e remover conteúdos violadores

Melhoramos nossa tecnologia de detecção proativa de conteúdos violadores, o que resultou em um aumento na remoção desse tipo de conteúdo, e queda no número de pessoas expostas a eles.

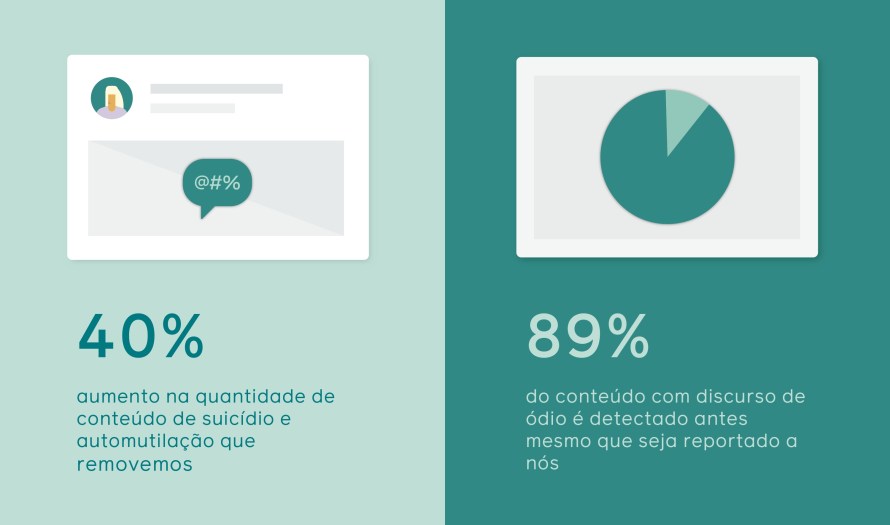

- No Facebook, continuamos a expandir para mais idiomas nossa tecnologia de detecção proativa de discursos de ódio e, em geral, melhoramos nossos sistemas de detecção existentes. Nossa taxa de detecção proativa para discurso de ódio aumentou mais de 8 pontos nos últimos dois trimestres, culminando em um crescimento de quase 20 pontos em apenas um ano. Como resultado, podemos encontrar mais conteúdo e, agora, detectar quase 90% do que removemos antes que alguém denuncie para nós. Adicionalmente, graças a outras melhorias que fizemos em nossa tecnologia de detecção, dobramos a quantidade de conteúdo removido relacionado a drogas no quarto trimestre de 2019, resultando na derrubada de 8,8 milhões de conteúdos.

- No Instagram, aprimoramos nossa tecnologia de correspondência de texto e imagem para nos ajudar a encontrar mais conteúdo relacionado a suicídio e automutilação. Como resultado, aumentamos em 40% a quantidade de conteúdo sobre os quais tomamos medidas e crescemos nossa taxa de detecção proativa em mais de 12 pontos desde o último relatório. Também tivemos progresso em nosso trabalho de combate ao bullying online, introduzindo vários novos recursos para ajudar as pessoas a gerenciar sua experiência e limitar interações indesejadas. Também anunciamos hoje novos controles no Instagram. Estamos compartilhando dados de esforços contra o bullying no Instagram pela primeira vez nesse relatório, incluindo a aplicação de medidas em 1,5 milhão de conteúdos no quarto trimestre de 2019 e no primeiro trimestre de 2020.

- Por fim, melhorias em nossa tecnologia para detectar e remover conteúdo semelhante a violações existentes em nossos bancos de dados nos ajudaram a remover mais conteúdo de nudez infantil e exploração sexual no Facebook e Instagram.

Nos últimos seis meses, começamos a usar mais a tecnologia para priorizar conteúdos a serem revisados por nossas equipes com base em fatores como viralidade, gravidade, entre outros. De agora em diante, planejamos nos apoiar mais em tecnologia para também agir sobre determinados conteúdos, incluindo a remoção automática de publicações. Isso permitirá que nossos revisores de conteúdo concentrem seu tempo em outros tipos de conteúdo em que são necessárias mais nuance e contexto para a tomada de decisão.

O Relatório de Aplicação dos Padrões da Comunidade é publicado em conjunto com o Relatório de Transparência semestral, que compartilha números sobre solicitações de autoridades, restrições de conteúdo com base em leis locais, derrubada de conteúdo em função de propriedade intelectual e problemas na internet.

No futuro, compartilharemos os Relatórios de Aplicação dos Padrões da Comunidade trimestralmente, portanto nosso próximo relatório será lançado em agosto.