Por Guy Rosen, VP de Integridad; Katie Harbath, Directora de Políticas Públicas para Elecciones; Nathaniel Gleicher, Director de Políticas de Ciberseguridad; y Rob Leathern, Director de Gestión de Producto

Tenemos la responsabilidad de frenar el abuso y la interferencia electoral en nuestra plataforma. Y es por eso que desde el 2016 hemos realizado inversiones significativas para identificar nuevas amenazas, eliminar vulnerabilidades y reducir la difusión de desinformación viral y las cuentas falsas.

Hoy, a casi un año de las elecciones del 2020 en Estados Unidos, estamos anunciando nuevas medidas para ayudar a proteger el proceso democrático y ofrecer una actualización sobre las iniciativas en curso:

Combate a la interferencia extranjera

- Actuamos contra el comportamiento inauténtico en nuestros servicios y actualizamos nuestras políticas.

- Protegemos las cuentas de los candidatos, funcionarios electos y sus equipos a través de Facebook Protect.

Mayor transparencia

- Dimos más transparencia a las Páginas y mostramos quiénes son sus dueños

- Identificamos a la prensa controlada por el Estado en sus Páginas y también en la Biblioteca de Anuncios.

- Facilitamos la comprensión de anuncios políticos, incluyendo un nuevo mecanismo para acompañar el gasto de los candidatos presidenciales en Estados Unidos.

Reducción de la desinformación

- Prevenimos la difusión de desinformación, incluyendo etiquetas más claras para identificar el contenido verificado.

- Combatimos la supresión del voto y la interferencia, incluyendo la prohibición de anuncios que sugieren que votar es inútil o aconsejan a la gente que no vote

- Ayudamos a las personas a entender mejor la información que ven online e hicimos una inversión inicial de 2 millones de dólares en proyectos de educación sobre medios.

Interferencia extranjera

Combatiendo el Comportamiento Inauténtico

En los últimos tres años hemos trabajado para identificar nuevas amenazas y eliminar el comportamiento inauténtico coordinado de nuestros apps. Durante el último año desmantelamos 50 redes a nivel global, en muchos casos antes de elecciones democráticas relevantes. Como parte de nuestros esfuerzos para combatir las campañas de interferencia extranjera, esta mañana eliminamos cuatro redes de cuentas, Páginas y Grupos en Facebook e Instagram involucradas en comportamiento inauténtico coordinado. Tres de ellas tenían su origen en Irán y una en Rusia. Sus objetivos estaban en Estados Unidos, en el norte de África y América Latina. Identificamos estas campañas de manipulación como parte de nuestras investigaciones internas sobre supuesto comportamiento inauténtico vinculado a Irán y de nuestro trabajo proactivo con miras a las elecciones en Estados Unidos.

Eliminamos estas redes en base a su comportamiento y no al contenido que publicaban. Nuestras acciones se basaron en que, en todos los casos, las personas detrás de esta actividad actuaban de forma coordinada y usaban cuentas falsas para ocultar su identidad. Hemos compartido nuestros hallazgos con las autoridades y con nuestros socios de la industria. Para más detalles, ver aquí.

A medida que hemos mejorado nuestra capacidad de discontinuar este tipo de operaciones, hemos también logrado una mejor comprensión sobre las diferentes amenazas y cómo contrarrestarlas. Hemos investigado y tomado medidas contra todo tipo de comportamiento inauténtico. Sin embargo, la forma de responder a alguien que impulsa la popularidad de sus publicaciones en su propio país puede no ser la mejor forma de combatir interferencias externas. Por eso hemos actualizado nuestra política de comportamiento inauténtico para aclarar cómo respondemos a una serie de prácticas engañosas que vemos en nuestras plataformas, ya sean extranjeras o domésticas, auspiciadas por un Estado o no.

Protegiendo las cuentas de candidatos, funcionarios electos y sus equipos

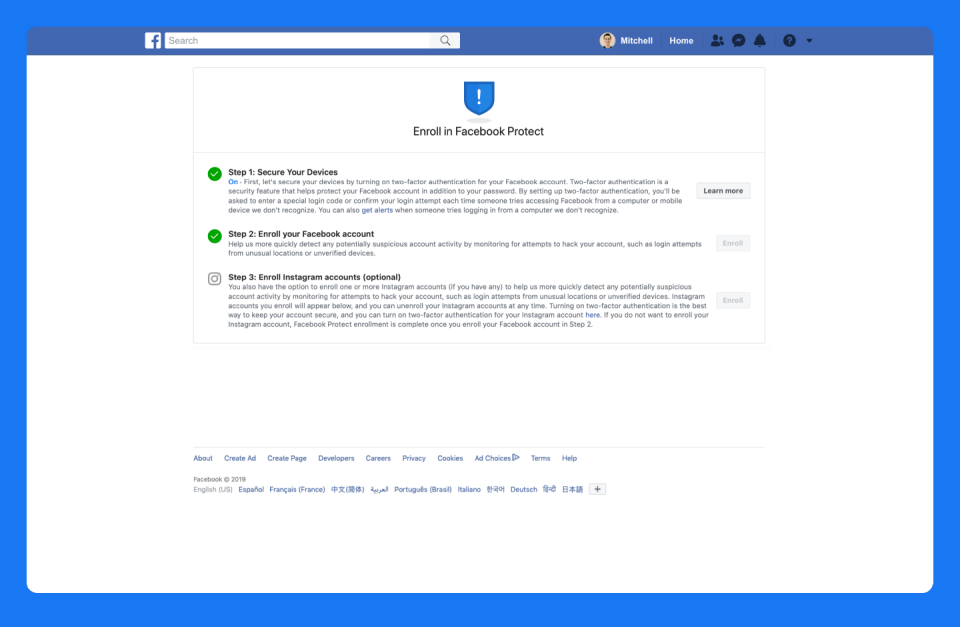

Hoy estamos lanzando Facebook Protect para ofrecer más seguridad a las cuentas de los funcionarios electos, candidatos, sus equipos y otras personas que puedan sentirse especialmente vulnerables a ataques de hackers y adversarios extranjeros. Como hemos visto en elecciones pasadas, estas personas pueden ser blanco de actividad maliciosa. Sin embargo, como las campañas tienen una duración limitada, no siempre sabemos quiénes son las personas vinculadas a ellas, lo que dificulta su protección.

A partir de ahora, los administradores de páginas podrán suscribir las cuentas de Facebook e Instagram de sus organizaciones a Facebook Protect e invitar también a los miembros de sus organizaciones a participar en el programa. Par hacerlo, deberán activar la autenticación de dos factores y sus cuentas serán monitoreadas para detectar ataques como, por ejemplo, intentos de acceso desde lugares inusuales o desde dispositivos no verificados. Si descubrimos un ataque contra una cuenta, podemos revisar y proteger otras cuentas asociadas con la misma organización que forman parte de nuestro programa. Puede leer más sobre Facebook Protect y sumarse al programa aquí.

Aumentando la transparencia

Transparencia en las Páginas

Queremos estar seguros de que las personas usen Facebook de una manera auténtica y que entiendan con quién interactúan. En el último año, hemos tomado medidas para asegurar que las Páginas sean auténticas y más transparentes, mostrando a las personas la ubicación primaria de las Páginas e información acerca de si ya se fusionó con otra. Eso ofrece más contexto y facilita entender quién está detrás de ella.

Cada vez más, vemos que las personas no informan la organización que está detrás de una Página para dar la impresión de que se trata de una Página independiente. Para resolver eso, hemos agregado más datos sobre quién es el o los responsables, incluyendo una nueva pestaña de “Organizaciones que administran esta Página”, que incluirá el “Dueño confirmado de la Página” con el nombre legal de la organización y la ciudad, número de teléfono o página web verificada, entre otros.

Inicialmente, esta información sólo aparecerá en Páginas con grandes audiencias en Estados Unidos que han pasado por la verificación de negocios de Facebook. Además, las Páginas que fueron autorizadas a usar anuncios sobre asuntos sociales, elecciones o políticos en Estados Unidos también tendrán esta pestaña. Y a partir de enero, estos anunciantes deberán mostrar el dato del “Dueño de Página Confirmado”.

Si encontramos una Página que está ocultando quién es su dueño para engañar a las personas, vamos a exigir que complete el proceso de verificación y que ofrezca más información para poder permanecer activa.

Identificando medios estatales

Queremos brindar a las personas más contexto sobre el contenido noticioso que ven en Facebook para que puedan tomar decisiones informadas sobre lo que están leyendo. A partir del mes próximo, comenzaremos a identificar como medios estatales a aquellas organizaciones editoriales que estén parcial o completamente bajo control de un estamento del Estado. Esta etiqueta estará presente en su Página y en nuestra Biblioteca de Anuncios.

Aplicaremos estándares más altos de transparencia para estas Páginas porque combinan las cualidades de ser formadoras de opinión y de contar con el respaldo estratégico de un Estado.

Desarrollamos nuestra propia definición y nuestros estándares para identificar medios estatales con el aporte de más de 40 expertos alrededor del mundo, especialistas en medios, gobernanza, derechos humanos y desarrollo. Consultamos con prestigiosas instituciones académicas, organizaciones sin fines de lucro y organismos internacionales como Reporteros Sin Fronteras, el Centro para la Asistencia Internacional de Medios, el Centro Europeo de Periodismo, El Proyecto de Propaganda Computacional del Instituto de Internet de Oxford, el Centro de Medios, Datos y Sociedad (CMDS) de la Universidad Central Europea, UNESCO y otros.

Es importante recalcar que nuestra política distingue entre medios estatales y medios públicos, definidos como una entidad de financiamiento público y con una misión de servicio público, que puede demostrar independencia editorial. En este momento, estamos enfocados en identificar solo a medios estatales.

Actualizaremos la lista de medios estatales de forma periódica comenzando en noviembre. Y, de cara al 2020, ampliaremos el uso de estas etiquetas en publicaciones específicas y en Instagram, también. Contaremos con procesos de apelación para aquellas organizaciones que estén en desacuerdo con recibir la etiqueta de medio estatal.

Más claridad sobre anuncios políticos

Además de hacer más transparente a las Páginas, estamos actualizando nuestra Biblioteca de Anuncios, nuestro Informe sobre la Biblioteca de Anuncios y nuestra API de la Biblioteca de Anuncios para que más periodistas, funcionarios, investigadores y otros actores puedan acceder a nueva información sobre los anuncios que ven. Esto incluye:

- Una nueva medición de la inversión de los candidatos a la presidencia en Estados Unidos, con el objetivo de que las personas puedan ver cuánto han invertido los candidatos en anuncios.

- Nuevos detalles sobre inversión publicitaria a nivel estatal o regional con el objetivo de ayudar a las personas a analizar iniciativas publicitarias y de campaña que buscan alcanzar a los votantes en forma geográfica.

- Detalles sobre si un anuncio corrió en Facebook, Instagram, Messenger o Audience Network.

- Nuevos filtros para la API que brindan acceso programático para descargar las piezas publicitarias (creatividad) y un repositorio de API scripts frecuentemente usados.

Además de las actualizaciones para la API de la Biblioteca de Anuncios, en noviembre comenzaremos a probar una nueva base de datos con investigadores que les permitirá descargar rápidamente la totalidad de la Biblioteca de Anuncios, hacer recortes diarios y realizar un seguimiento de cambios día por día.

Visita nuestro Centro de Ayuda para más detalles sobre los cambios que aplicarán a nuestras

Páginas y a nuestra Biblioteca de Anuncios.

Combatiendo la desinformación

Previniendo la difusión viral de la desinformación

Trabajamos para detener la difusión de desinformación en Facebook e Instagram. Reducimos su alcance para que llegue a menos personas: en Instagram removemos la desinformación de la sección Explorar y de los hashtags, y en Facebook reducimos su distribución en el News Feed. Además, en Instagram filtramos de Explore y de las páginas de hashtags el contenido de aquellas cuentas que publican desinformación con frecuencia. En Facebook, si hay Páginas, dominios o Grupos que comparten desinformación reiteradas veces, limitamos su distribución y restringimos la capacidad de publicitar o monetizar de la Página.

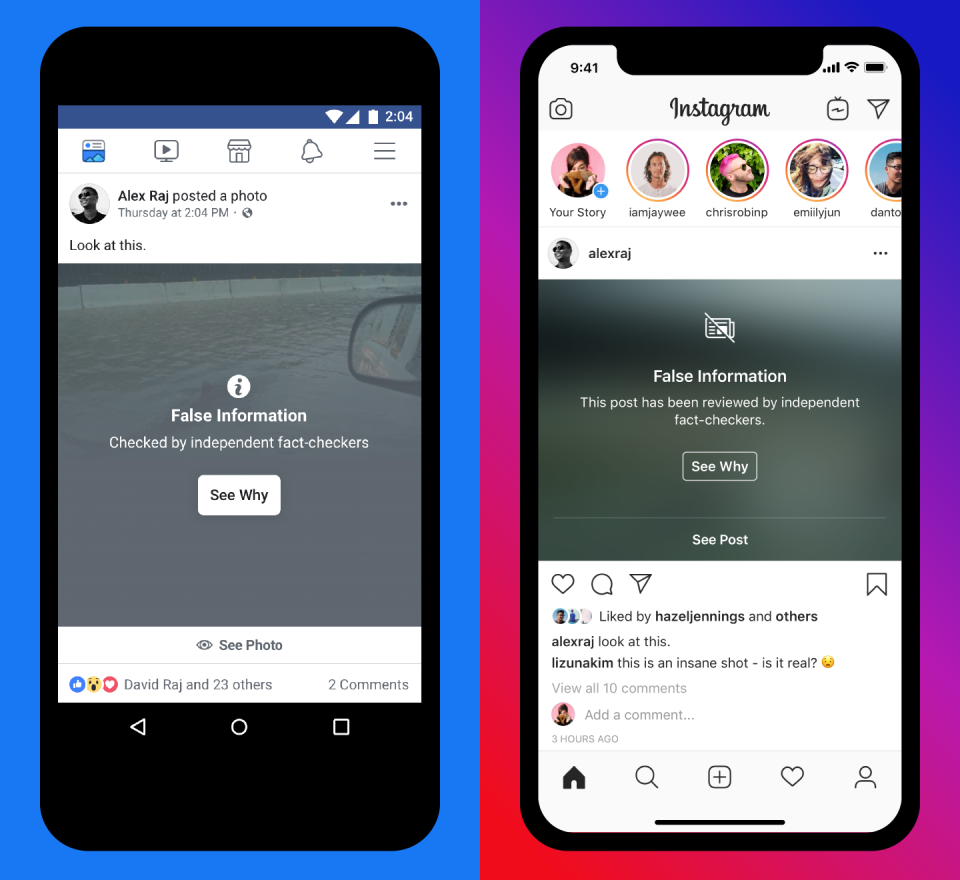

En el curso del próximo mes, el contenido marcado como falso o engañoso por verificadores de información independientes, será identificado de forma más prominente en Facebook y en Instagram para que las personas puedan decidir con más facilidad qué leer, en qué confiar y qué compartir. Estas etiquetas aparecerán arriba de vídeos y fotos falsos o engañosos y también en Stories de Instagram, e incluiremos el enlace al artículo esclarecedor escrito por el verificador de información.

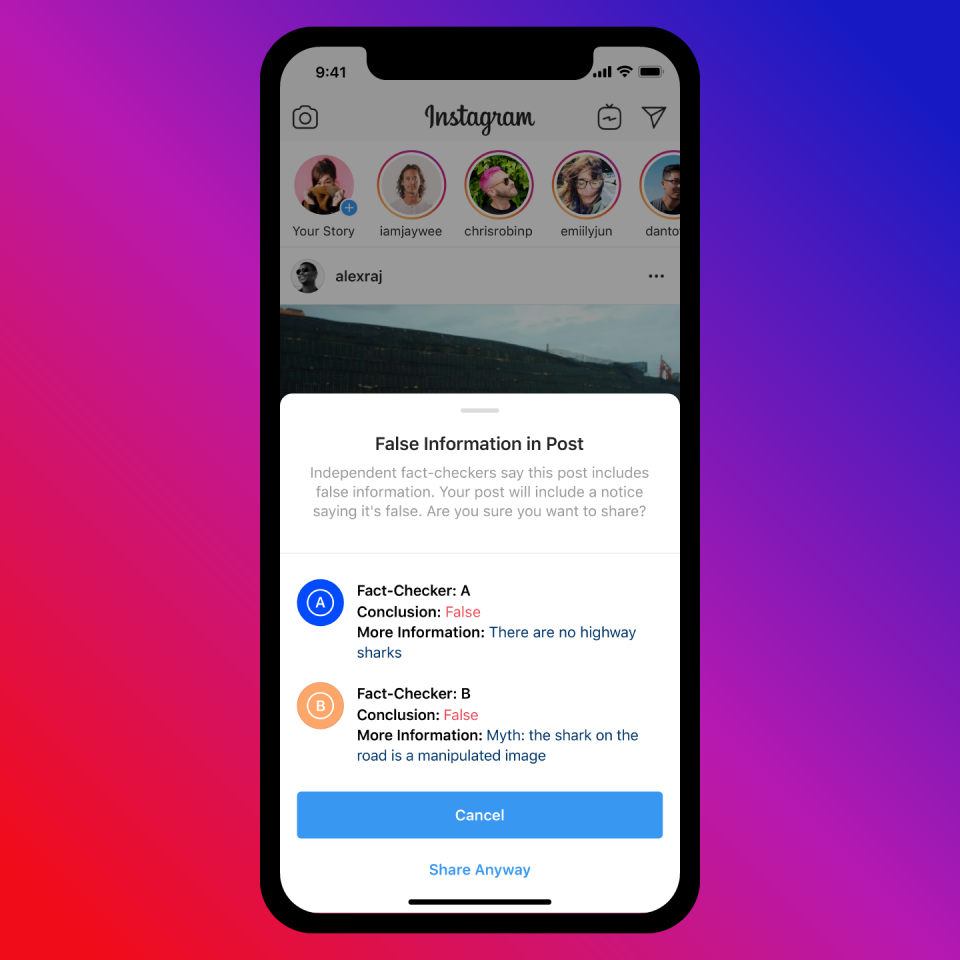

De manera similar a lo que hacemos en Facebook, cuando las personas intenten compartir desinformación aparecerá un nuevo pop-up que incluirá contenido que ha sido desmentido por verificadores de información.

Además de etiquetas más claras, también estamos trabajando para actuar más rápidamente para prevenir que la desinformación se torne viral, ya que el reporte de calidad y la verificación de la información toman tiempo. En muchos países, incluyendo Estados Unidos, en caso que hallemos señales de que una pieza de contenido es falsa, reduciremos temporalmente su distribución hasta que pueda ser revisado por una de las verificadoras que trabajan con nosotros.

El combate contra la supresión de votos y la intimidación

Los intentos de interferir o suprimir votos erosionan nuestros valores como compañía y trabajamos proactivamente para remover ese tipo de contenido. En 2018, previo a las elecciones de medio período en Estados Unidos, ampliamos nuestras políticas contra la supresión del voto y la intimidación y prohibimos:

- Tergiversar las fechas, lugares, horarios y métodos de votación o de registro para votar;

- Tergiversar quién puede votar, los requisitos para hacerlo, la determinación de cuándo un voto es válido y qué información es necesaria para votar (ej: «si ya votó en las elecciones primarias, no es necesario votar en la presidencial»); y

- Amenazas de violencia vinculadas al voto, al registro para votar o al resultado de la elección.

Eliminamos este tipo de contenido sin importar su procedencia y, en la previa de las elecciones de medio período en Estados Unidos, nuestro Centro de Operaciones para Elecciones removió más de 45.000 piezas de contenido que violaban esas políticas. Y más del 90% fue detectado por nuestros sistemas antes de que nadie llegara a reportarlo.

También sabemos que algunos contenidos, como el discurso de odio, pueden derivar en supresión del voto. Es por eso que nuestras normas sobre lenguaje de odio prohíben prácticas que pretendan reducir la participación política, incluyendo asuntos como raza o religión.

De cara a las elecciones presidenciales estadounidenses de 2020, estamos implementando políticas adicionales y ampliando nuestras capacidades técnicas en Facebook e Instagram para proteger la integridad de ese proceso. Siguiendo el compromiso que adoptamos en el reporte de auditoría sobre derechos civiles publicado en junio, hemos implementado ahora una política que prohíbe anuncios pagos que sugieran que votar es inútil o carece de sentido, o que aconseje a las personas a no hacerlo.

Nuestros sistemas son ahora más efectivos en detectar y remover proactivamente este tipo de contenido dañino. Usamos «machine learning» para ayudarnos a identificar rápidamente información sobre la votación que pueda ser incorrecta, y procedemos a removerla.

Seguimos expandiendo y articulando sociedades para generar conocimiento acerca de las prácticas de supresión del voto e intimidación, junto con la detección temprana de contenido violatorio de nuestras normas. Esto incluye un trabajo conjunto con secretarías de Estado y direcciones electorales para tratar asuntos de supresión del voto en forma localizada, que puedan estar sucediendo en un distrito particular. Esta tarea será apoyada por nuestro Centro de Operaciones para Elecciones durante las elecciones primarias y las generales.

Una ayuda para entender más acerca de lo que vemos online

Parte de nuestro trabajo para frenar la distribución de desinformación pasa por ayudar a las personas a identificarla por sí mismas. Y es por eso que nos asociamos con expertos en alfabetización mediática. Hoy, anunciamos una inversión inicial de 2 millones de dólares para apoyar proyectos que empoderen a las personas a determinar qué leer y qué compartir, ya sea en Facebook o en cualquier otro lugar.

Estas iniciativas incluyen programas de entrenamiento para asegurar que las mayores cuentas de Instagram tengan los recursos necesarios para reducir la distribución de desinformación, la expansión de un programa piloto para que ciudadanos mayores y estudiantes de secundaria aprendan sobre seguridad online y alfabetización mediática y el apoyo a eventos públicos en librerías locales, centros comunitarios y bibliotecas de todo el país. También estamos respaldando una serie de eventos de entrenamiento para desarrollar pensamiento crítico entre quienes votan por primera vez.

También incluimos una serie de clases de alfabetización mediática en nuestra Biblioteca de Alfabetización Digital. Esas lecciones fueron tomadas del equipo de Jóvenes y Medios del Centro Berkman Klein para Internet y Sociedad de la Universidad de Harvard, que las puso disposición en forma gratuita a nivel global bajo una licencia Creative Commons. Las lecciones, creadas para educadores fueron diseñadas para ser interactivas y cubrir temas que van desde la evaluación de la calidad de la información en línea hasta la generación de habilidades técnicas, como la búsqueda inversa de imágenes.

Seguiremos desarrollando iniciativas en el campo de la alfabetización mediática en Estados Unidos y pronto tendremos más noticias para compartir.