Por Guy Rosen, VP Integridad de Facebook

Hoy publicamos nuestro tercer Informe sobre el Cumplimiento de las Normas Comunitarias entre el cuarto trimestre de 2018 y el primero de 2019. Este informe contiene algunas novedades en relación a los anteriores:

Lo nuevo de la tercera edición

- Datos sobre apelaciones y contenido que fue restaurado: por primera vez, estamos reportando la cantidad de apelaciones y de contenido que fue restaurado después de que nuestra decisión original.

- Datos sobre bienes regulados: el reporte incluye nuestras acciones para eliminar los intentos de venta ilícita de productos regulados, específicamente, armas de fuego y drogas, una categoría que se suma a las ocho áreas ya cubiertas en la segunda edición del informe (noviembre de 2018).

En total, detallamos métricas de nueve áreas de nuestras Normas Comunitarias: desnudez y actividad sexual, bullying y hostigamiento, desnudos infantiles y explotación sexual de niños, cuentas falsas, discursos de odio, productos regulados, correo no deseado, propaganda terrorista global y violencia, y contenido gráfico.

¿Cómo interpretar estos números?

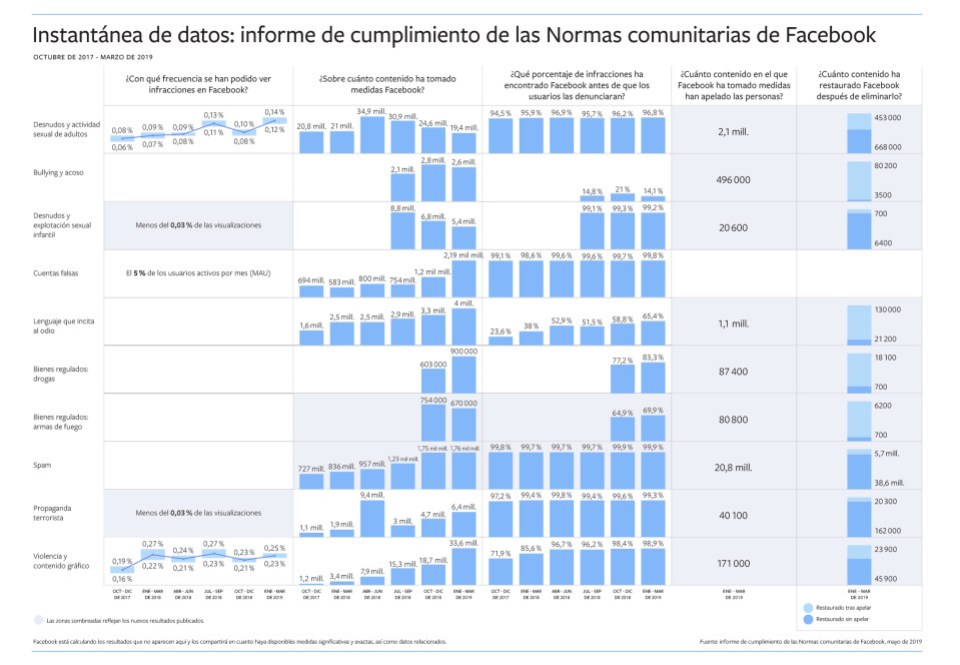

Las métricas centrales de nuestro informe, que agregadas muestran el desempeño de nuestras Normas Comunitarias, son:

Prevalencia: frecuencia con la que es vista contenido que viola nuestras Normas Comunitarias. Es importante para nosotros conocer la frecuencia con la que es visto el contenido que viola nuestras políticas. El volumen sobre el que actuamos refleja la cantidad de posts eliminados, mientras que la prevalencia mide el volumen que aún no identificamos y que por lo tanto todavía puede ser visto. Analizamos periódicamente muestras del contenido que es visto en Facebook y luego calculamos el porcentaje de ese material que infringe nuestros estándares.

Esta métrica está actualmente disponible para desnudez y actividad sexual, para violencia y contenido gráfico, y también para cuentas falsas:

- Estimamos que por cada 10.000 veces que las personas vieron contenido en Facebook, entre 11 y 14 tenían elementos que violan nuestra política de desnudez y actividad sexual para adultos.

- Estimamos que por cada 10.000 veces que las personas vieron contenido en Facebook, 25 tenían elementos que infringen nuestra política de violencia y contenido gráfico.

- Para las cuentas falsas, estimamos que el 5% de las cuentas activas mensuales son falsas.

En este informe, también estamos compartiendo por primera vez una métrica de prevalencia para el terrorismo global y también para desnudez infantil y explotación sexual. La prevalencia para ambas áreas es demasiado baja para medirla utilizando nuestros mecanismos estándar. Sin embargo, podemos estimar que en el primer trimestre de 2019, por cada 10.000 veces que las personas vieron contenido en Facebook, menos de 3 tenían elementos que violaban cualquiera de éstas políticas.

- Seguimos desarrollando métricas de prevalencia para las áreas que incluimos en el informe. Esta métrica refleja cuánto contenido publicado viola nuestras políticas y qué tan bien podemos identificarlo.

Contenido accionado: la cantidad de contenido sobre el que actuamos por violar nuestras Normas Comunitarias. Nuestras acciones incluyen eliminar el contenido, aplicar una pantalla para advertir a los usuarios acerca de la naturaleza del contenido o deshabilitar cuentas. Los datos reflejan la cantidad de contenido que viola nuestras políticas y qué tan bien podemos identificarlo.

Para las cuentas falsas, la cantidad de cuentas sobre las que actuamos se incrementó debido a los ataques automáticos por parte de actores maliciosos que intentan crear grandes volúmenes de cuentas en forma simultánea. Inhabilitamos 1.200 millones de cuentas en el cuarto trimestre de 2018 y 2.19 mil millones en el primer trimestre de 2019. La mayoría de estas cuentas fueron bloqueadas apenas minutos después de su creación y antes de que pudieran causar daño, por lo que no llegaron a ser consideradas como cuentas activas. Continuaremos buscando nuevas formas de contrarrestar estos intentos y nuestro vicepresidente de Analytics, Alex Schultz, explica más acerca de cómo abordamos las cuentas falsas en nuestro Blogpost de Preguntas Difíciles.

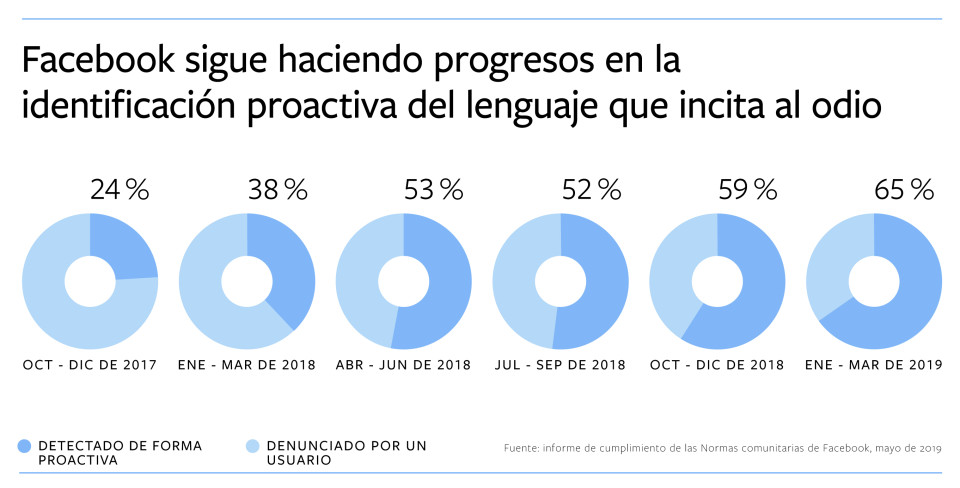

Tasa de proactividad: cantidad de contenido sobre el que actuamos detectado por nuestros sistemas antes de que alguien lo reportara. Esta métrica generalmente refleja cuán efectiva es la inteligencia artificial (IA) sobre un área en particular.

En seis de las áreas de nuestras políticas incluidas en este informe, detectamos proactivamente más del 95% del contenido sobre el que tomamos medidas antes de que alguien lo reportara.

En el caso del discurso de odio, detectamos el 65% del contenido que eliminamos, desde el 24% de un año atrás. En el primer trimestre de 2019 eliminamos 4 millones de publicaciones con mensajes de odio y seguimos invirtiendo en tecnología para ampliar nuestras capacidad de detectar este tipo de contenido en diferentes idiomas y regiones.

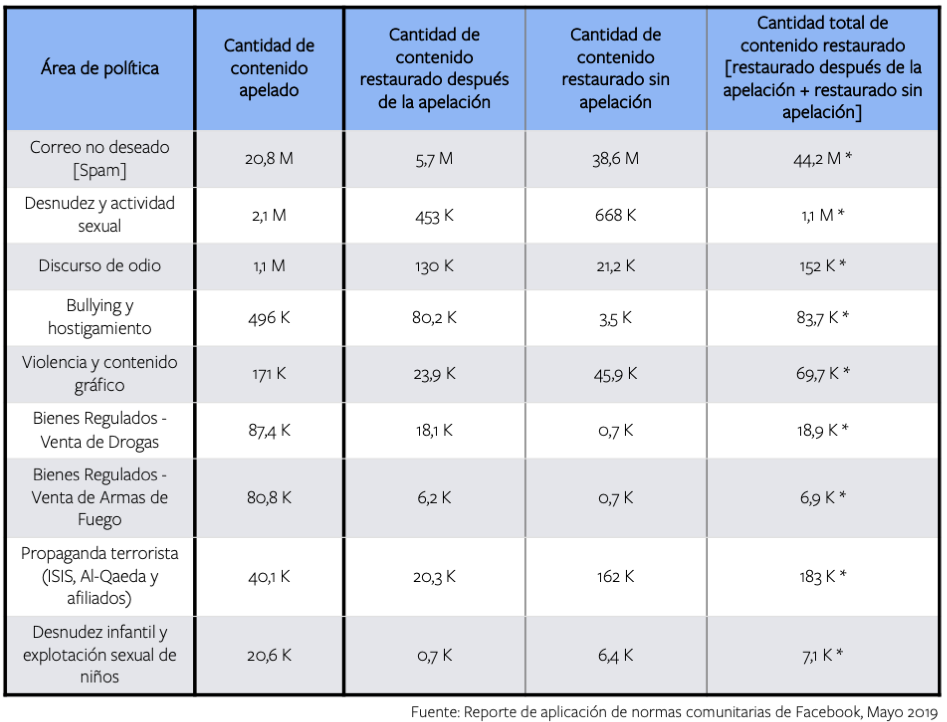

Nuevo en este reporte: apelaciones y corrección de nuestros errores

Cuando tomamos medidas sobre algún contenido notificamos a la persona que lo publicó y, en la mayoría de los casos, les ofrecemos la posibilidad de decirnos por qué creen que cometimos un error. En la tercera edición de este reporte comenzamos a publicar datos sobre la cantidad de contenido que las personas apelaron y sobre el contenido que fue restaurado.

La aplicación de nuestras normas no es perfecta y, tan pronto como identificamos un error, trabajamos para solucionarlo. Es por eso que incluimos la cantidad de contenido que se restauró después de ser apelado y la cantidad que restauramos por nuestra cuenta, incluso si no hubo reclamo. Restauramos contenido sin necesidad de apelaciones por varias razones, entre ellas:

- Cuando por error eliminamos múltiples posts en un mismo contenido podemos restaurar todas las publicaciones en base a una única apelación.

- A veces, identificamos un error en nuestra revisión y restauramos el contenido antes de que sea apelado.

- En otras ocasiones, especialmente en casos de spam, cuando eliminamos publicaciones que contienen enlaces identificados como maliciosos, podemos restaurar las publicaciones al cuando el enlace ya no es perjudicial.

Incluimos esta información para el primer trimestre de 2019 en cada área de políticas en el informe, a excepción de las cuentas falsas:

* Nota: Es importante considerar que la cantidad de contenido restaurado después de ser apelado, o incluso sin reclamo, puede no sumar exactamente la cantidad total de contenido restaurado debido al redondeo.La «cantidad de contenido apelado» en un trimestre no puede ser comparado directamente con la «cantidad de contenido restaurado» en ese mismo periodo, ya que el material restaurado en el primer trimestre de 2019 puede haber sido apelado en el cuarto trimestre de 2018. De manera similar, la «cantidad de contenido apelado» en el primer trimestre de 2019 puede haber sido accionado en el cuarto trimestre de 2018.

Más información sobre el proceso de apelaciones aquí.

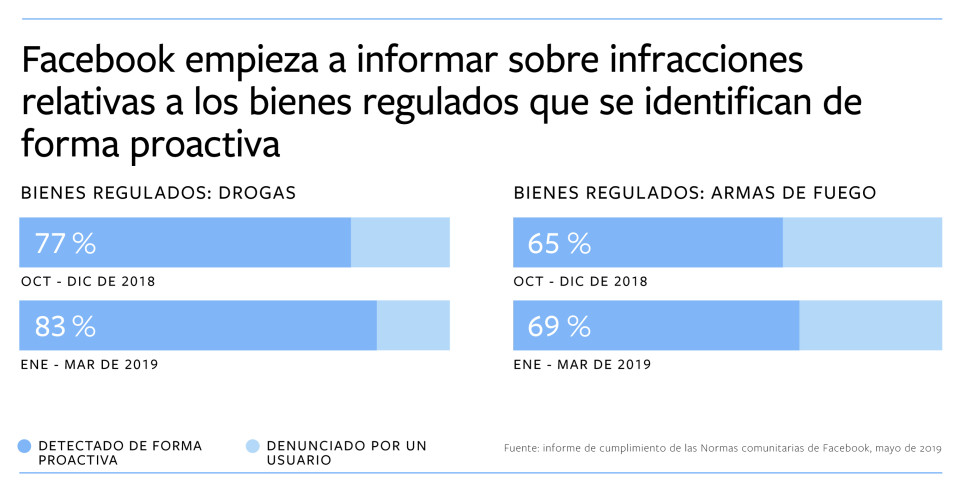

Nuevo en este reporte: datos sobre bienes regulados

Tenemos políticas desde hace mucho tiempo contra la venta de drogas ilícitas y armas de fuego. Durante años, hemos utilizado una variedad de enfoques para hacerlas cumplir, como: investigar perfiles, Páginas, Grupos, hashtags y cuentas asociadas a violaciones de contenido que ya hemos eliminado; bloquear y filtrar cientos de términos asociados con la venta de medicamentos; y trabajar con expertos para mantenernos al día sobre las últimas tácticas que los actores maliciosos utilizan para enmascarar su actividad, como nuevas formas coloquiales de llamar a las drogas.

En el verano de 2018, comenzamos a usar IA con el fin de identificar contenido que viola nuestras políticas de productos regulados. Esta inversión nos ha permitido tomar más medidas, y en la mayoría de los casos, hacerlo antes de que las personas lo reporten. En el primer trimestre de 2019, actuamos sobre aproximadamente 900.000 piezas ligadas a ventas de medicamentos, de los cuales el 83,3% fue detectado proactivamente. En ese mismo período, tomamos medidas sobre aproximadamente 670.000 piezas ligadas al comercio de armas de fuego, de las cuales el 69,9% fue hallado de manera proactiva.

Al captar proactivamente una mayor cantidad de posts que violan nuestras políticas, esta tecnología permite a nuestro equipo enfocarse en identificar las nuevas formas en que los actores maliciosos podrían desarrollar para evitar ser detectados.

Nuestro compromiso con la transparencia

Durante el último año, hemos dado una serie de pasos para ser más transparentes en la forma en que desarrollamos nuestras políticas y en cómo medimos nuestros esfuerzos para que sean cumplidas. Comenzamos a compartir la minuta de nuestra reunión quincenal en la que determinamos las actualizaciones de nuestras políticas, y ahora proporcionamos un registro de cambios en el sitio web de Normas Comunitarias para que todos puedan ver exactamente qué actualizamos. Además, como parte de nuestros esfuerzos para facilitar la investigación académica, otorgamos becas para 19 propuestas de investigación en todo el mundo para estudiar nuestras políticas de contenido y cómo el contenido en línea influye en los eventos que suceden fuera de internet.

Una revisión externa independiente y los aportes que pueda hacer son un componente integral de nuestro sistema. Con ese espíritu, establecimos el Grupo Asesor de Transparencia de Datos (DTAG), compuesto por expertos internacionales en medición, estadística, criminología y gobernanza, para proporcionar una evaluación pública e independiente que indique si las métricas que compartimos en el Informe de Cumplimiento de Normas Comunitarias son significativas y precisas para nuestro trabajo. Aportamos a esos asesores información detallada y confidencial sobre nuestros procesos de cumplimiento y metodologías de medición, y esta semana publicaron su evaluación. El informe reportó que el cumplimiento de las normas comunitarias es un ejercicio importante en materia de transparencia y consideran que nuestro enfoque y metodología son sólidos y razonables. También, destacaron otras áreas en las que podríamos ser más abiertos de manera de incrementar la responsabilidad y la capacidad de respuesta con los usuarios. Estas importantes consideraciones ayudarán a nuestro trabajo futuro.

Seguiremos incorporando una mayor transparencia a nuestro trabajo e incluiremos más información sobre nuestros esfuerzos en este sentido, para que las personas puedan seguir nuestro progreso y exigirnos que rindamos cuentas en las áreas en las que debemos hacer más trabajo.