利用者の皆様にFacebook上で安心してコンテンツを共有していただくためには、安全な環境づくりが必要だと考えています。Facebookは、過去2年間に渡り、不適切なコンテンツをより効果的に削除するため、テクノロジーと人員への投資を行ってきました。今年の春には、コミュニティ規定違反を判断するための社内ガイドラインを初めて公開し、何がFacebookで共有できるのか、それはなぜなのかについてコミュニティと共有しました。さらに、5月には、Facebookの取り組みに対する客観的な判断基準として、Facebookがこれまでに削除した違反コンテンツの件数も公開しました。

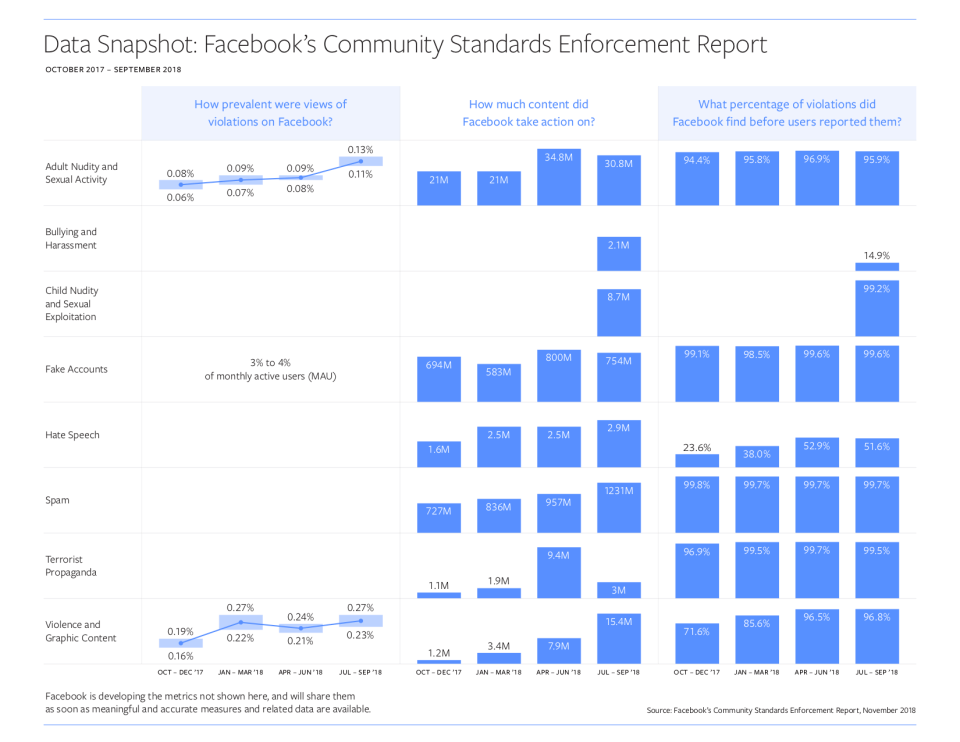

Facebookはこの度、2度目となる「コミュニティ規定施行レポート」を公開します。本報告書では、「過度な暴力描写」、「成人のヌードと性的行為」のほか、「テロリストによるプロパガンダ」、「ヘイトスピーチ」、「スパム」、「偽アカウント」に対する当社の取り組み状況(2018年4月~9月の6か月間)が示されています。本報告書にはさらに、「いじめと嫌がらせ」、「児童ポルノと子どもの性的搾取」の2つの項目が新たに追加されました。

規定違反コンテンツの検出

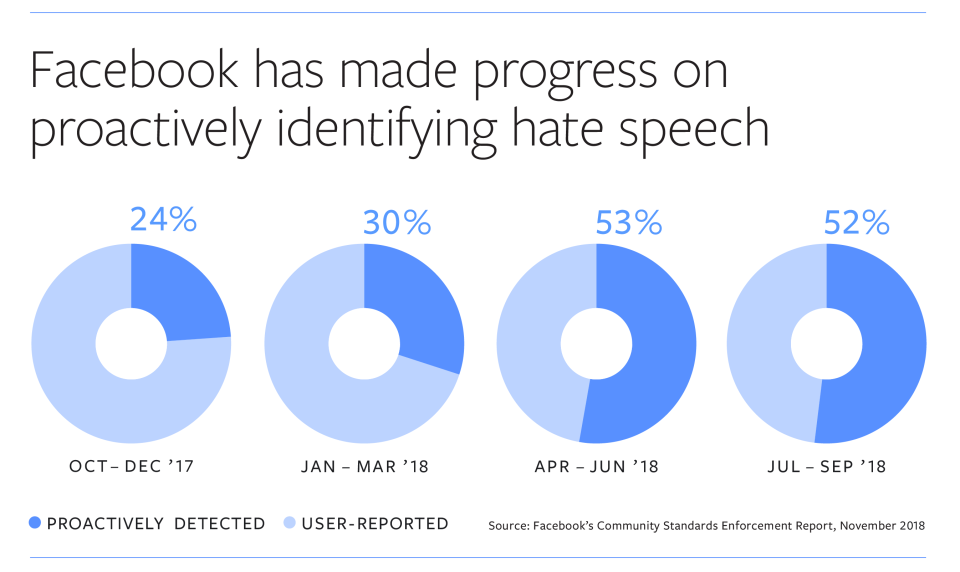

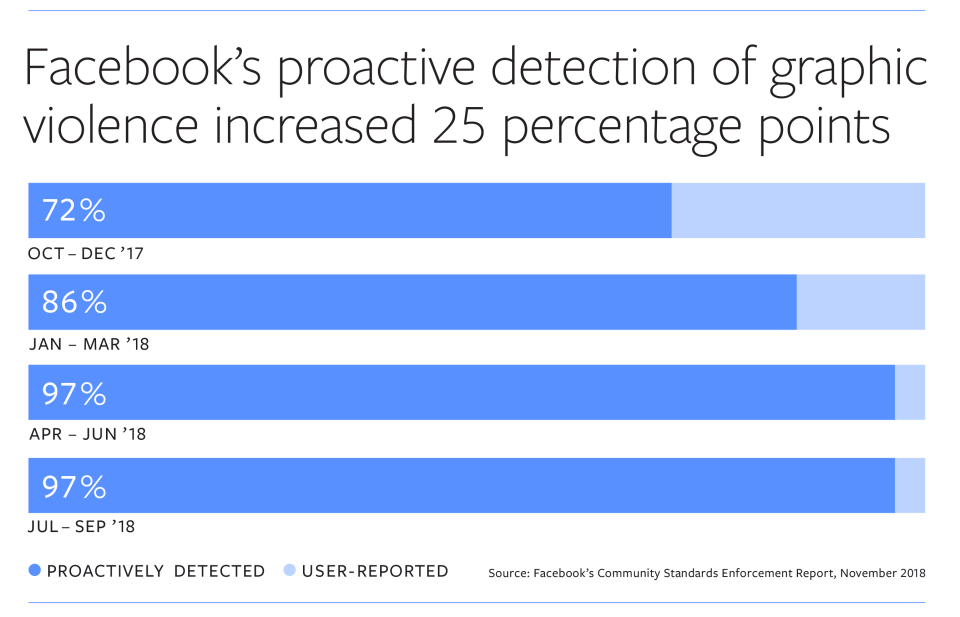

特に「ヘイトスピーチ」や「過度な暴力描写」に関しては、利用者による報告が行われる前に違反コンテンツを検出する体制が整いつつありますが、改善すべき点も依然として残っています。

- 1つ目の報告書の公開以降、利用者による報告の前にFacebookが検出した「ヘイトスピーチ」の件数の割合は、24%から52%に倍増しました。「ヘイトスピーチ」に関して言えば、その大半を利用者による報告の前に検出し、規定違反コンテンツとして削除しています。当社はこれを非常に重要な業務と位置付けており、特にまだ初期段階にある取り組みに対し引き続き投資を続けると共に、使用人口の少ない言語に対する「ヘイトスピーチ」検出の強化に努めてまいります。

- 「過度な暴力描写」に関して、検出率は72%から97%へと、25%も上昇しました。

規定違反コンテンツ・アカウントの削除

改善されているのは不適切なコンテンツの検出だけではありません。2018年第3四半期にFacebookが措置を講じた「過度な暴力描写」を含むコンテンツの件数は、2017年第4四半期の件数の10倍を上回る1540万件に上りました。このような対応強化の背景には、類似性が非常に高い、もしくは同じようなコンテンツに対し、同一の措置を自動的に適用する独自の技術の改善に、Facebookが継続的に取り組んでいる事実が関係しています。また、2018年第2四半期には、テロリストに関連する940万件のコンテンツを削除しました。Facebookは、すでにデータベースにある規定違反コンテンツに極めて類似する画像をすぐに検出する技術、写真照合システムの活用を拡大することで、テロリストによる過去のプロパガンダ投稿の削除にも努めてきました。Facebookの規定に違反する一部コンテンツの削除を妨げてきた不具合が修正されたことも、削除件数の増加に寄与しました。

同様に、第2・第3四半期における「偽アカウント」の削除件数も、第1四半期を上回る8億40万件、7億5370万件と、それぞれ増加しました。これらの「偽アカウント」の大半は、「偽アカウント」の大量作成を狙う商業目的のスパム攻撃により生じます。「偽アカウント」の大半を登録後数分以内に削除できる体制を整備したことで、「偽アカウント」の割合を月間アクティブユーザー数の3~4%以内に常時収めることができました。

新項目の追加

本報告書には、「いじめと嫌がらせ」、「児童ポルノと子どもの性的搾取」の2つの項目を新たに追加しました。今後は本報告書内のデータを起点とし、これらの分野における規定違反への対応の進捗状況も、長期的に測定してまいります。

「いじめと嫌がらせ」には利用者の皆様の個人の要素やコンテクストから切り離せない性質があるため、Facebookによる特定・削除に先立って、関係者による報告が必要とされる場合がほとんどです。そのため、事前に特定できる確率は、その他の違反に比べて低くなります。前四半期には、「いじめと嫌がらせ」に関するFacebookの規定に違反したコンテンツ210万件に対して措置を講じましたが、利用者による報告に先立って削除されたコンテンツは15%でした。これらは、その他の違反を検出中に特定されたものです。「いじめと嫌がらせ」の場合、Facebookによる対応に先立った被害者自身による報告が必要となる場合が多い点が、被害者の精神的な負担となっています。Facebookは「いじめと嫌がらせ」行為を無くすべく理解を深めていくことで、より自主的な検出の実現を目指しています。

Facebookのコミュニティ規定は、子どもに対する搾取を禁止しています。また、子どもがお風呂に入っている写真などの悪意のないコンテンツも悪用されてしまう可能性を考慮し、削除しています。「児童ポルノと子どもの性的搾取」に関する規定に違反したコンテンツの削除件数は、前四半期だけで870万件に上り、そのうち99%が利用者による報告の前に削除されました。また、Facebook上での子どもに対する搾取に対処するため、人工知能や機械学習を使って子どものヌード写真や悪用される可能性のある投稿を検出し、子どもたちと不適切なやりとりをした可能性のあるアカウントの検出をも可能にする新しい技術についても先日発表しました。これにより不適切なコンテンツの検出がより迅速化されると確信しています。

Facebook上での不正行為の防止には、今後もより多くの取り組みが必要であると認識しています。機械学習や人工知能は、Facebook上の不適切なコンテンツの検出・削除に、今後も大いに役立つことでしょう。また、進捗状況の測定は、Facebook社員がこの課題に対する取り組みや責任ある業務の遂行への注力を継続させるためにも欠かせない要素です。Facebookは、イェール大学法科大学院の教職員率いる評価・ガバナンス分野の専門家団体DTAG(Data Transparency Advisory Group)と連携し、業務体制やデータ処理手順の公正な評価に努めてきました。今後もこのような長期的な改善に努めることで、より正確かつ有意義なデータを提供していきます。

最新の「コミュニティ規定施行レポート」および政府からの要請やIPアドレスの削除に関する最新情報は、

こちらでご覧いただけます。いずれの報告書も、2019年前半には15か国以上でご覧いただける予定です。

Downloads:

画像をダウンロード