Wikipedia est régulièrement classé parmi les 10 sites web les plus consultés dans le monde. C’est bien souvent notre premier recours lorsque nous recherchons des informations sur des personnages historiques ou des acteurs du changement. Mais tout le monde n’y est pas représenté de manière égale. Environ 20 % seulement des biographies sur le site en anglais concernent des femmes, selon la Fondation Wikimedia. Cette proportion est sans doute encore plus faible pour celles à l’intersection de plusieurs minorités, comme les scientifiques, les africaines et les asiatiques.

Dans le cadre de mon projet de doctorat en informatique à l’Université de Lorraine, en France, au sein de l’Institut national de recherche en sciences et technologies du numérique (INRIA), j’ai travaillé aux côtés de Claire Gardent, ma directrice de thèse, au développement d’une nouvelle solution qui permettrait de remédier à ce déséquilibre grâce à l’intelligence artificielle (IA). Nous avons créé un système d’IA capable d’effectuer des recherches et de rédiger les premières ébauches des articles biographiques dans le style propre à Wikipédia. Il reste encore du travail, mais nous espérons qu’à terme ce nouveau système aidera les éditeurs et éditrices de Wikipédia à créer des milliers d’articles biographiques fiables et intéressants sur des personnalités de premier plan qui ne figurent pas encore sur le site.

Le sujet me tenait personnellement à cœur : j’avais observé le manque de représentation dans les collections des bibliothèques durant mes années d’école primaire. Quand j’étais en CE2, on m’a demandé de faire une rédaction sur un personnage historique, avec une seule contrainte : que la bibliothèque dispose de sa biographie. Je voulais écrire sur Eleanor Roosevelt, mais j’ai dû me contenter de Teddy Roosevelt. Et si j’avais voulu parler d’une personne qui me ressemble ? Aurais-je seulement pu le faire ? Si nous imaginions le même exercice aujourd’hui, les élèves utiliseraient sûrement Internet, et plus probablement Wikipédia. Alors que Wikipédia compte des millions d’articles en anglais (dont un excellent article sur Eleanor Roosevelt), nous savons qu’il existe encore de nombreuses femmes dont les histoires et les accomplissements n’atteignent pas la postérité.

Alors que les femmes sont plus susceptibles d’écrire des biographies à propos d’autres femmes, le Community Insights 2021 Report de Wikimedia qui porte sur l’année écoulée, a révélé que seules 15 % des personnes contribuant à Wikipédia s’identifient comme appartenant à la gent féminine. Ces dernières sont donc oubliées et sous-représentées, malgré l’impact considérable qu’elles ont eu au cours de l’histoire dans les sciences, les affaires, la politique et tous les autres domaines de notre société. La physicienne canadienne Donna Strickland a remporté le prix Nobel de physique en 2018. Cependant, les internautes cherchant des informations à son sujet sur Wikipédia ne les auraient pas trouvées. Ce n’est que quelques jours après qu’elle a remporté le prix le plus prestigieux dans son domaine d’étude qu’une biographie Wikipédia est publiée à propos de ses précieux travaux. Diverses études, émanant notamment de la Wikimedia Foundation elle-même, ont également dénoncé le déséquilibre entre les genres sur la plateforme. Même avec ce manque de représentation, les biographies de femmes étaient toujours proposées à la suppression de façon disproportionnée. En effet, une étude a révélé qu’en 2017, 41 % des biographies proposées à la suppression concernaient des femmes.

Nous pensons qu’une méthode ouverte et reproductible peut constituer un premier pas vers la résolution de ce problème. Aujourd’hui, nous mettons en libre accès un modèle d’IA de bout en bout qui crée automatiquement des articles biographiques d’excellente qualité sur des personnalités publiques de premier plan.

Notre modèle explore les sites web à la recherche d’informations pertinentes et rédige un article type Wikipédia sur cette personne, accompagné de références. Nous publions également un nouvel ensemble de données créé pour évaluer les performances du modèle sur 1 527 biographies de femmes issues de groupes marginalisés. Cet ensemble de données peut servir à entraîner des nouveaux modèles, ainsi qu’évaluer les performances du modèle existant et le faire progresser. Nous pensons que ces entrées générées par l’IA peuvent être utilisées comme point de départ par les personnes qui rédigent le contenu de Wikipédia et celles qui vérifient les informations, afin de publier davantage de biographies de groupes sous-représentés sur le site.

Nous avons encore tant à faire pour diversifier la représentation des personnalités issues de tous horizons sur Wikipédia. Fondamentalement, les systèmes d’IA tels que celui que nous avons créé devront relever des défis sociétaux et techniques plus vastes afin de résoudre pleinement le problème. À commencer par les contenus web utilisés pour créer les articles Wikipédia, qui sont parfois erronés ou reflètent nos biais culturels. D’un point de vue technique, le système de génération de texte peut avoir tendance à faire apparaître des contenus non factuels. Même les meilleurs moteurs de traitement du langage peinent encore aujourd’hui à produire un texte cohérent sur plusieurs paragraphes. Nous espérons les améliorer en perfectionnant les architectures neuronales qui alimentent ces modèles et en innovant en matière de développement responsable de l’intelligence artificielle.

À terme, nous espérons que cette approche aidera des non-spécialistes à produire des articles fiables pour enrichir la documentation disponible sur le web, et ce, sans nécessiter de corrections majeures.

Comment l’IA peut-elle contribuer à la lutte contre les préjugés ?

Notre modèle est un grand pas en avant pour appuyer et renforcer les autres initiatives existantes qui visent à améliorer l’équilibre des genres sur Wikipédia. Les éditrices bénévoles Jessica Wade et Penny Richards ont collaboré en toute indépendance pour écrire et publier sur Wikipédia des milliers de biographies de femmes qui méritent d’être mises en lumière. Nous pouvons également mentionner une autre initiative collective remarquable, le Women in Red Wiki Project, qui mobilise des éditrices et éditeurs désireux de rédiger des biographies et de compléter celles qui existent déjà sur des femmes remarquables d’hier et d’aujourd’hui.

Nous avons donc opté pour une solution complémentaire. La recherche, la création d’une bibliographie et la rédaction sont des tâches complexes, mais il existe une multitude d’informations disponibles sur le web pour raconter l’histoire de femmes dont les accomplissements, les voix et les héritages ont été oubliés ou relégués au second plan.

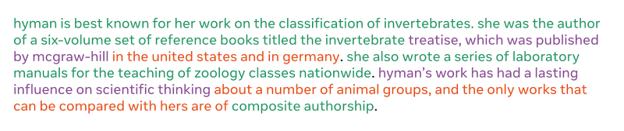

Par exemple, nous avons utilisé notre modèle pour générer une courte biographie de Libbie Hyman, une pionnière dans le domaine de la zoologie des invertébrés. Le texte vert est tiré de l’article de référence qui a servi de point de départ, le texte violet est tiré des informations du web, et le texte orange signale la présence d’éléments non factuels, ce qui signifie que le modèle a inventé des informations non vérifiables.

Le modèle a récupéré des informations biographiques pertinentes sur Libbie Hyman, dont son intérêt pour les invertébrés, ses publications importantes et l’impact de son travail, qui peuvent ensuite être utilisées comme point de départ par les éditeurs et éditrices pour vérifier les faits (un domaine où le modèle présente encore des lacunes), ainsi qu’étoffer sa biographie et ses accomplissements.

Utilisation du pré-entraînement et d’un modèle de recherche pour générer des biographies sur Wikipédia

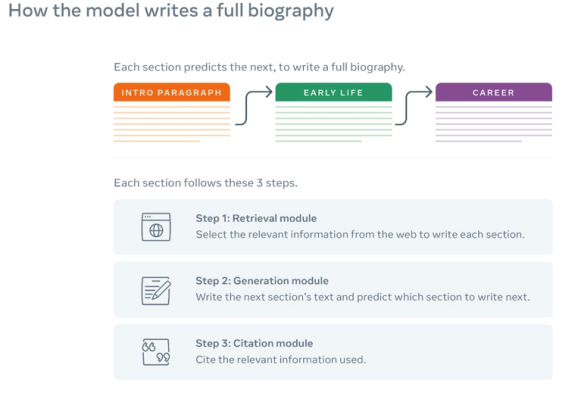

Nous commençons le processus de génération d’une biographie en utilisant une matrice de génération augmentée par la recherche, qui repose sur un pré-entraînement à grande échelle, et qui apprend au modèle à identifier uniquement les informations utiles, telles que le lieu de naissance ou le lieu où la personne a fait ses études, à mesure qu’il élabore la biographie.

Le modèle extrait d’abord des informations pertinentes sur Internet pour présenter le sujet. Ensuite, le module de génération crée le texte, et la troisième phase, le module de citation, établit la bibliographie qui renvoie aux sources utilisées. Le processus se répète alors, chaque partie prédisant celle qui suit, pour couvrir tous les aspects constitutifs d’une bonne biographie Wikipédia, notamment son enfance, sa formation et son parcours professionnel.

La génération d’informations se fait section par section, à l’aide d’un mécanisme de mise en cache semblable à celui de Transformer-XL, afin de renvoyer aux sections existantes et d’atteindre un degré de contextualisation plus élevé au niveau du document. La mise en cache est essentielle, car elle permet au modèle de mieux retracer ce qu’il a déjà produit.

Les évaluations automatiques et humaines montrent que le modèle est capable de trouver des informations pertinentes et de les utiliser pour générer des biographies, mais beaucoup reste à faire. Ces évaluations ont révélé que 68 % du texte généré dans les biographies que nous avons créées ne se trouvait pas dans le corpus de référence. Cela peut signifier plusieurs choses. On pourrait en déduire que le modèle réussit à trouver et à synthétiser des informations pertinentes sans pour autant devenir un outil de plagiat. Cependant, il est également imprécis : il est difficile de savoir quelles informations sont exactes et lesquelles sont erronées. Nous avons demandé aux équipes d’évaluation de déterminer si des phrases complètes étaient conformes aux faits, et dans de nombreux cas, elles n’étaient que partiellement vérifiables. Ces difficultés sont analogues aux défis rencontrés par la génération de texte en général, bien qu’elles soient exacerbées dans le cas des groupes marginalisés, car il existe très peu de données à leur sujet. Nous espérons que la diffusion de cet ensemble de données permettra à d’autres spécialistes d’étudier ce problème.

Nous avons rencontré plusieurs autres obstacles au cours de nos recherches. Tout d’abord, le manque de données pour entraîner le moteur ou d’articles biographiques existants sur les femmes s’est révélé un problème de taille. Les articles qui portent sur les femmes, en particulier celles issues de groupes marginalisés, sont nettement plus courts que la moyenne des articles sur les hommes, sont moins détaillés et utilisent un langage différent. Par exemple, on lira « femme scientifique » au lieu de simplement « scientifique ». Ce biais dans les données d’entraînement a été intériorisé par les modèles. De plus, les articles de Wikipédia doivent être rédigés à partir de sources factuelles, souvent issues du web. Cependant, le parti pris de Wikipedia vaut aussi pour Internet : il existe très peu de sites web pouvant faire office de sources vérifiées.

Les problèmes bien ancrés ne se résolvent pas du jour au lendemain, mais c’est exactement le type de problématique où la technologie peut être utilisée afin de faire évoluer les choses.

Et après ? Accroître la visibilité des personnes sous-représentées sur Wikipédia

Nous nous réjouissons de partager ce travail avec la communauté afin de stimuler les échanges, les expérimentations et les avancées qui permettront d’améliorer l’équité dans l’offre de contenu sur Wikipédia.

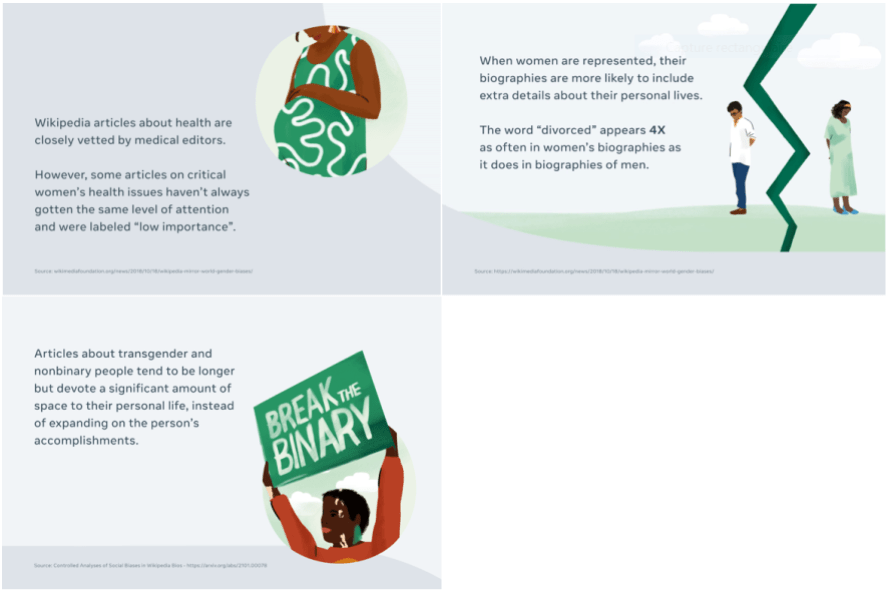

Notre modèle ne résout que partiellement un problème multidimensionnel. Il reste donc d’autres domaines où de nouvelles technologies devraient être étudiées. Lorsqu’une personne contribuant à Wikipédia ou notre modèle d’IA compose une biographie, des informations sont tirées du web, puis citées. Cependant, malgré toute la richesse du savoir disponible sur Internet, certaines sources présentent un parti pris dont il faut tenir compte. Par exemple, lorsque les femmes sont représentées, leur biographie est plus susceptible de comporter des informations supplémentaires sur leur vie personnelle. Une étude de 2015 a révélé que le mot « divorcé » apparaît quatre fois plus souvent dans les biographies des femmes que dans celles des hommes. Les raisons sont multiples, comme le fait que les tabloïds ont tendance à se concentrer davantage sur la vie des femmes célèbres que sur celle des hommes. Il en résulte que les détails personnels sont plus susceptibles d’être mentionnés dans les articles sur celles-ci, ce qui a pour effet de faire oublier des réalisations qui devraient être mises en avant et valorisées.

La technologie a déjà permis de corriger certains déséquilibres, ce qui prouve que la communauté a encore une marge de manœuvre pour faire bouger les lignes. Par exemple, l’ancien directeur général du site a expliqué comment un algorithme a décelé une faille majeure. En effet, alors que les articles de Wikipédia portant sur la santé sont passés au crible par des personnes spécialisées en rédaction médicale, pendant des années, certains articles traitant de sujets cruciaux pour la santé des femmes, comme l’allaitement, ont été classés comme étant de « faible importance ».

Il reste encore du chemin à parcourir pour d’autres groupes marginalisés et intersectionnels dans le monde entier et dans toutes les langues. Notre évaluation et notre ensemble de données se concentrent sur les femmes, excluant ainsi de nombreux autres groupes, dont les personnes non binaires. Les articles sur les personnes transgenres et non binaires sont généralement plus longs, mais une large partie du surplus de texte est consacrée à leur vie personnelle au lieu de s’étendre sur leurs réalisations, selon une étude de 2021 qui a examiné les biais sociaux dans les articles de Wikipédia. Il est important de reconnaître que la partialité existe sous diverses formes, notamment dans les sources d’information en ligne proposées par défaut.

Nous sommes animés par le désir de faire partager ce domaine de recherche important à l’ensemble de la communauté des chercheurs et chercheuses dans le domaine de la génération par l’IA. Nous espérons que nos techniques pourront être utilisées comme point de départ pour les personnes qui enrichissent le contenu Wikipédia de leurs articles, et qu’elles permettront d’améliorer l’équité des informations en ligne accessibles aux étudiants qui rédigent des biographies, et à bien d’autres.