Hoje, pela primeira vez, estamos incluindo a prevalência do discurso de ódio no Facebook como parte de nosso Relatório de Aplicação dos Padrões da Comunidade trimestral.

Como medimos a prevalência do discurso de ódio

A prevalência estima a porcentagem de vezes que as pessoas veem conteúdo violador em nossa plataforma. Calculamos a prevalência de discurso de ódio selecionando uma amostra do conteúdo visto no Facebook e rotulando o quanto dela viola nossas políticas de discurso de ódio. Como o discurso de ódio depende do idioma e do contexto cultural, enviamos esses exemplos representativos para revisores em diferentes idiomas e regiões. Com base nessa metodologia, estimamos que a prevalência de discurso de ódio de julho de 2020 a setembro de 2020 foi de 0,10% a 0,11%. Em outras palavras, em cada 10.000 visualizações de conteúdo no Facebook, 10 a 11 incluíam discurso de ódio.

Medimos especificamente quanto conteúdo nocivo pode ser visto no Facebook e Instagram porque a quantidade de vezes que o conteúdo é visto não é distribuído uniformemente. Um conteúdo pode se tornar viral e ser visto por muitas pessoas em um período muito curto de tempo, enquanto outro conteúdo pode ficar na internet por muito tempo e ser visto por poucas pessoas.

Avaliamos a eficácia da nossa aplicação de medidas tentando manter a prevalência de discurso de ódio em nossa plataforma a mais baixa possível, enquanto minimizamos os erros no conteúdo que removemos.

Definindo e lidando com as nuances do discurso de ódio

Definir discurso de ódio não é simples, pois existem muitas opiniões divergentes sobre o que constitui discurso de ódio. Nuance, história, idioma, religião e mudanças nas normas culturais são fatores importantes a serem considerados ao definirmos nossas políticas.

Baseado na contribuição de uma ampla gama de especialistas e partes interessadas em âmbito global, definimos discurso de ódio como aquilo que ataca diretamente as pessoas com base em características protegidas, incluindo raça, etnia, nacionalidade, afiliação religiosa, orientação sexual, sexo, gênero, identidade de gênero ou deficiência ou doença grave.

Nos últimos anos, expandimos nossas políticas para fornecer maior proteção contra diferentes tipos de abuso. Tomamos medidas para combater o nacionalismo branco e o separatismo branco; introduzimos novas regras sobre conteúdo que incita violência contra imigrantes; banimos a negação do holocausto; e atualizamos nossas políticas para levar em conta certos tipos de discurso de ódio implícito, como conteúdo retratando blackface ou estereótipos sobre judeus controlando o mundo.

Nosso objetivo é remover o discurso de ódio sempre que tomamos conhecimento, mas sabemos que ainda temos progresso a fazer. A linguagem continua a evoluir, e uma palavra que não era ofensiva ontem pode se tornar ofensiva amanhã. Isso significa que a aplicação de medidas em conteúdo é um equilíbrio delicado entre garantir que não deixamos passar discurso de ódio e, ao mesmo tempo, não remover outras formas de discurso permitidas. É por isso que priorizamos o conteúdo mais crítico para as pessoas analisarem com base em fatores como viralidade, gravidade do dano potencial e probabilidade de violação.

O papel das denúncias

Quando se trata de revisão de conteúdo, usamos uma combinação de denúncias das pessoas e tecnologia para localizar possível discurso de ódio no Facebook e Instagram. Todas as semanas, pessoas em todo o mundo denunciam milhões de conteúdos que acreditam que violam nossas políticas. Esses relatórios são revisados em mais de 50 idiomas e nos fornecem uma visão sobre o que está acontecendo em nossa plataforma para que possamos continuar a refinar nossas políticas.

Também nos esforçamos para melhorar nossas ferramentas de denúncia e facilitar a denúncia de conteúdo que as pessoas acham que possa violar nossas políticas, mas ainda há algumas limitações que podem prejudicar esse processo. Por exemplo, em áreas com menor alfabetização digital, as pessoas podem estar menos cientes da opção de denunciar um conteúdo. As pessoas também costumam denunciar conteúdo de que podem não gostar ou discordar, mas isso não viola nossas políticas, como relatar conteúdo de times esportivos rivais ou spoilers de programas de TV que ainda não assistiram. Além disso, parte do conteúdo pode ser visto por muitas pessoas antes de ser denunciado, então não podemos confiar apenas nas denúncias que são feitas.

Usamos IA (Inteligência Artificial) para ajudar a priorizar o conteúdo para revisão, para que nossos revisores possam se concentrar no conteúdo que causa mais danos e passar mais tempo treinando e medindo a qualidade de nossos sistemas automatizados.

O papel das ferramentas e sistemas de IA

Desenvolvemos ferramentas e sistemas de IA para encontrar e remover proativamente o discurso de ódio em grande escala. Como o discurso de ódio pode ser muito contextual, a detecção de IA requer a capacidade de revisar as postagens de forma holística, com contexto e em vários idiomas.

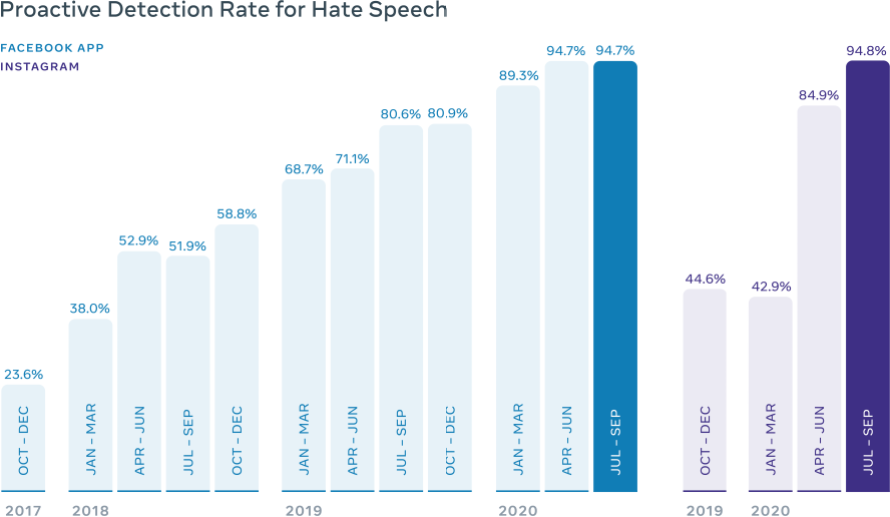

Os avanços na tecnologia de IA nos permitiram remover mais conteúdos com discurso de ódio do Facebook ao longo do tempo e encontrar mais deles antes mesmo que fossem reportados pelas pessoas. Quando começamos a divulgar nossas métricas de discurso de ódio, no quarto trimestre de 2017, nossa taxa de detecção proativa era de 23,6%. Isso significa que, do discurso de ódio que removemos, 23,6% dele foi encontrado antes de uma pessoa denunciá-lo. A maioria restante foi removida depois que uma pessoa relatou. Hoje, detectamos de forma proativa cerca de 95% do conteúdo de incitação ao ódio que removemos. Quer o conteúdo seja detectado de forma proativa ou denunciado pelas pessoas, geralmente usamos a IA para solucionar os casos simples e priorizar os casos difíceis para os revisores onde o contexto e as nuances precisam ser considerados.

Investimos bilhões de dólares em pessoas e tecnologia para aplicar essas regras e temos mais de 35.000 pessoas trabalhando em segurança e proteção no Facebook. Como a linguagem e o discurso de ódio podem mudar e evoluir ao longo do tempo, continuamos a revisar nossas políticas para refletir as mudanças nas tendências da sociedade. Mas acreditamos que as decisões sobre liberdade de expressão e segurança não devem ser tomadas apenas pelo Facebook, por isso continuamos a consultar especialistas para definir nossas políticas e métodos de aplicação. E para decisões de conteúdo difíceis e significativas, agora podemos encaminhar casos ao Comitê de Supervisão para sua revisão independente e decisões vinclulantes.

Com o uso de prevalência, denúncias e IA, estamos trabalhando para manter o Facebook e o Instagram ambientes inclusivos e seguros para todos que os usam.